W świecie zdominowanym przez rozdęte modele sztucznej inteligencji działające w chmurze, Mistral AI odwraca scenariusz. Francuski startup właśnie uwolniony dwa nowe modele — Ministral 3B i 8B — przeznaczone do pracy na urządzeniach brzegowych.

Les Ministraux: Ministral 3B i 8B

Nowa oferta Mistrala, nazwana „Les Ministraux”, może brzmieć jak francuski film artystyczny, ale te modele mogą wstrząsnąć światem sztucznej inteligencji. Mając odpowiednio 3 miliardy i 8 miliardów parametrów, rodzina Ministraux stawia na wydajność. Zapomnij o pochłaniających zasoby modelach sztucznej inteligencji, które do działania wymagają centrum danych.

„Nasi najbardziej innowacyjni klienci i partnerzy coraz częściej proszą o lokalne wnioskowanie uwzględniające prywatność w przypadku krytycznych aplikacji” – wyjaśnił Mistral.

Długość kontekstu jak nigdy dotąd

Tutaj robi się naprawdę pikantnie: zarówno modele 3B, jak i 8B mogą obsłużyć okno kontekstowe zawierające 128 000 tokenów. To odpowiednik 50-stronicowej książki. Dla porównania nawet OpenAI GPT-4 Turbo osiąga mniej więcej tę samą liczbę żetonów, a to nie lada wyczyn.

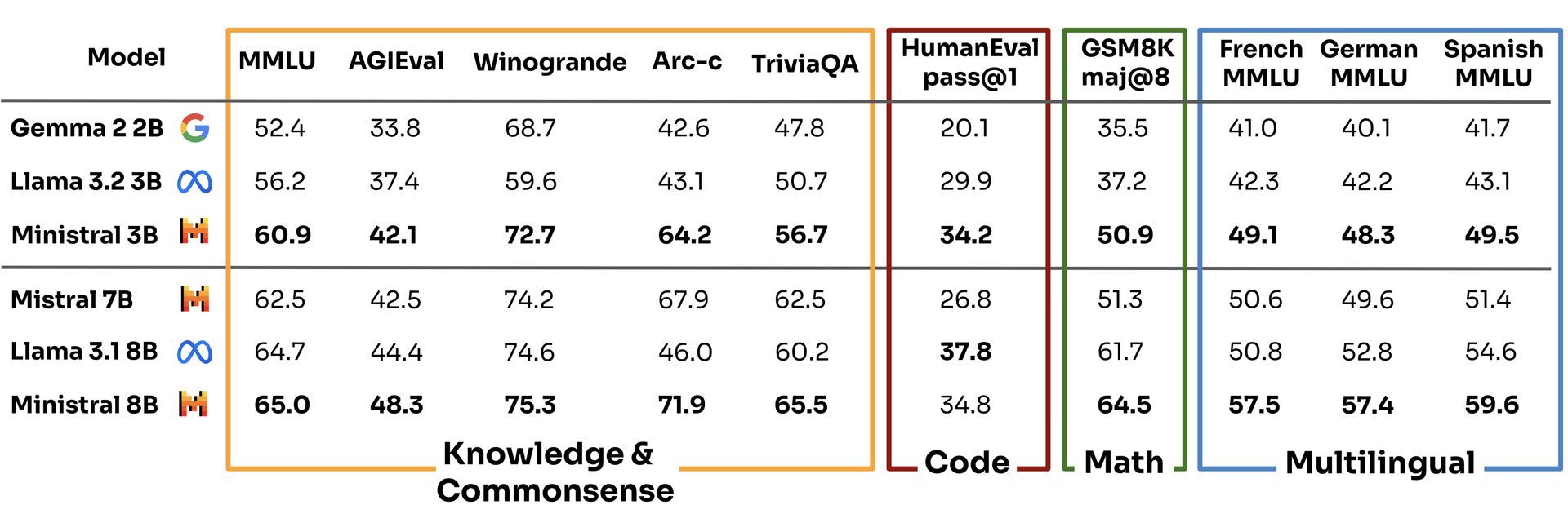

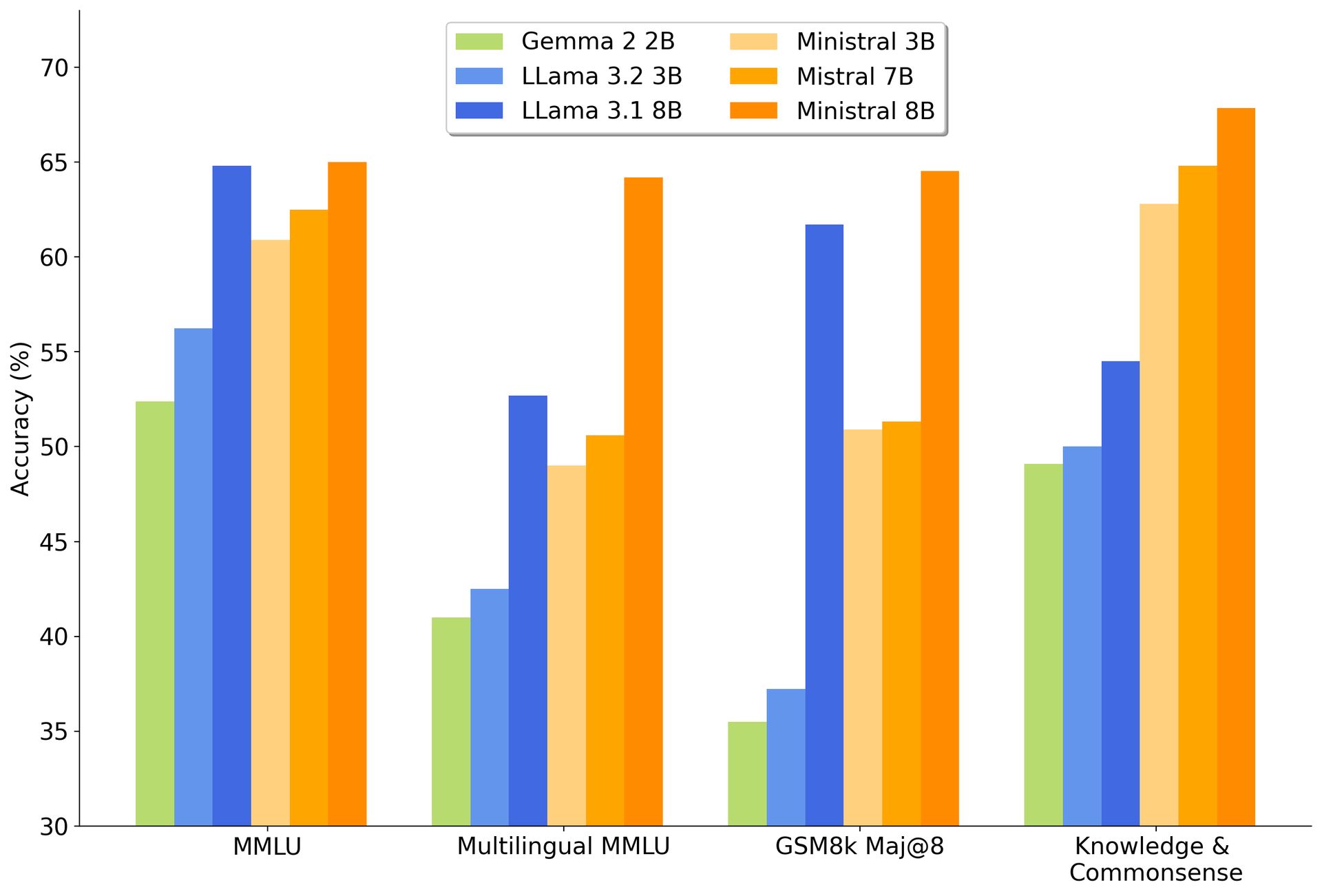

Dzięki tej pojemności modele Ministraux nie tylko przewyższają swojego poprzednika, Mistrala 7B, ale także pożerają technologię Google Gemma 2 2B I Modele lamy Meta na śniadanie.

Według własnych testów Mistral, model 3B uzyskał 60,9 w ocenie Multi-task Language Understanding, pozostawiając konkurentów takich jak Llama 3.2 3B i Gemma 2 2B z wynikami odpowiednio 56,2 i 52,4.

Nieźle jak na „mniejszy” model, prawda?

Podczas gdy wszyscy inni w świecie sztucznej inteligencji starają się tworzyć większe, gorsze modele, które pochłaniają energię, Mistral gra w inną grę. Działając na urządzeniach lokalnych, Les Ministraux eliminuje potrzebę stosowania ogromnych serwerów w chmurze, oferując w ten sposób opcję znacznie bardziej przyjazną dla środowiska. To posunięcie doskonale wpisuje się w rosnącą presję na firmy technologiczne, aby były bardziej świadome ekologicznie. Sztuczna inteligencja może być przyszłością, ale nikt nie chce, aby ta przyszłość nadeszła kosztem planety.

Istnieje również aspekt prywatności. Ponieważ wszystko działa lokalnie, Twoje dane pozostają na Twoim urządzeniu, co jest ogromną zaletą dla branż takich jak opieka zdrowotna i finanse, które w coraz większym stopniu są pod lupą pod kątem sposobu postępowania z poufnymi informacjami. Można o tym myśleć jak o sztucznej inteligencji bez szpiegowania – to odświeżająca zmiana w świecie, w którym każda aplikacja wydaje się gromadzić więcej danych niż NSA.

Główny plan Mistrala: buduj, zakłócaj, powtarzaj

Ale nie oszukujmy się – Mistral nie robi tego tylko dla większego dobra. Firma, której współzałożycielami są absolwenci Meta i DeepMind należącej do Google, zajmuje się robieniem fal. Zebrali już 640 milionów dolarów w postaci kapitału wysokiego ryzyka i skupiają się laserowo na budowaniu modeli sztucznej inteligencji, które nie tylko rywalizują z takimi modelami jak GPT-4 firmy OpenAI i Claude firmy Anthropic, ale także przynoszą zyski.

I choć zarabianie pieniędzy w przestrzeni generatywnej sztucznej inteligencji jest tak proste, jak wygrana na loterii, Mistral nie ma zamiaru się wycofywać. Tak naprawdę zaczęli generować przychody zeszłego lata, czyli więcej, niż można powiedzieć o wielu ich konkurentach.

Oferując Ministral 8B do celów badawczych i udostępniając oba modele za pośrednictwem platformy chmurowej La Platforme, Mistral pozycjonuje się jako fajny dzieciak w bloku AI – wystarczająco otwarty, aby przyciągnąć programistów, ale wystarczająco inteligentny, aby zarabiać na swojej technologii poprzez strategiczne partnerstwa. To podejście hybrydowe, które odzwierciedla to, co giganci open source, tacy jak Red Hat, zrobili w świecie Linuksa, wspierając społeczność, jednocześnie dbając o pracę kas fiskalnych.

Kredyty obrazkowe: Mistral