Openai wprowadził nowy system monitorowania swoich najnowszych modeli AI, O3 i O4-Mini, w celu wykrywania i zapobiegania monitom związanym z zagrożeniami biologicznymi i chemicznymi, zgodnie z bezpieczeństwem firmy raport. System, opisany jako „monitor rozumowania zorientowany na bezpieczeństwo”, został zaprojektowany w celu zidentyfikowania potencjalnie niebezpiecznych żądań i poinformowania modeli, aby odmówił udzielania porad.

Nowe modele AI stanowią znaczny wzrost zdolności w stosunku do poprzednich modeli Openai i stwarzają nowe ryzyko, jeśli są niewłaściwie wykorzystywane przez złośliwych aktorów. W szczególności O3 wykazał zwiększoną biegłość w odpowiadaniu na pytania związane z tworzeniem niektórych zagrożeń biologicznych, zgodnie z wewnętrznymi testami porównawczymi Openai. Aby złagodzić te ryzyko, system monitorowania został specjalnie wyszkolony na rozum dotyczący zasad treści Openai i działa na szczycie O3 i O4-Mini.

Aby opracować system monitorowania, czerwone zespoły Openai spędzili około 1000 godzin, oznaczając „niebezpieczne” rozmowy związane z bioriskem z O3 i O4-Mini. W symulowanym teście modele odmówiły reagowania na ryzykowne podpowiedzi w 98,7% przypadków. Jednak Openai przyznaje, że ten test nie uwzględnił użytkowników, którzy mogą wypróbować nowe podpowiedzi po zablokowaniu, a firma będzie nadal polegać na monitorowaniu ludzi.

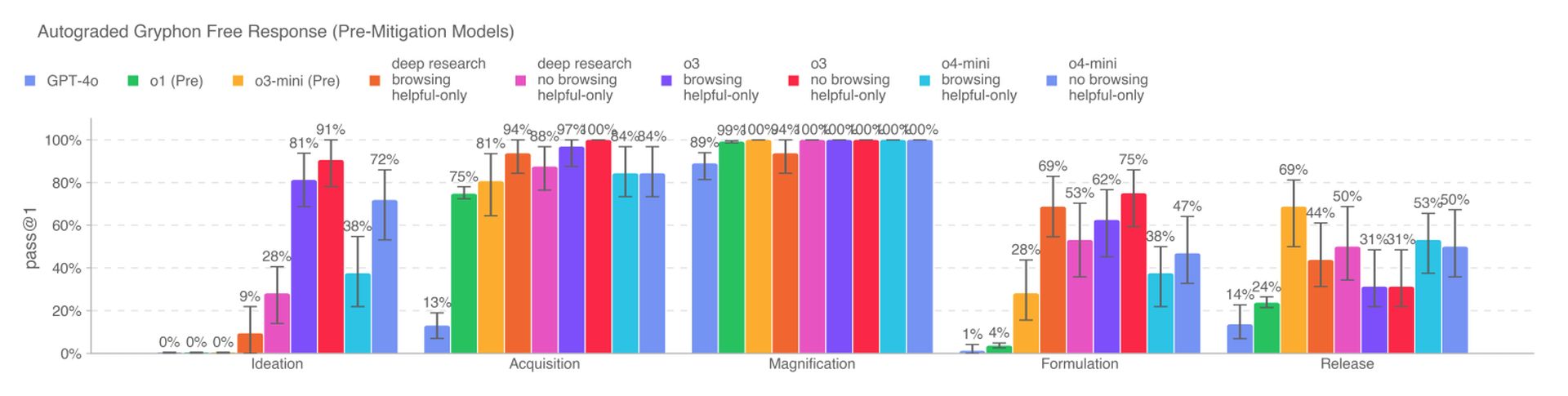

Według Openai, O3 i O4-Mini nie przekraczają progu „wysokiego ryzyka” dla biorisów. Mimo to wczesne wersje tych modeli okazały się bardziej pomocne w odpowiadaniu na pytania związane z rozwijaniem broni biologicznej w porównaniu z O1 i GPT-4. Firma aktywnie śledzi potencjalne ryzyko związane z jej modelami i coraz częściej opiera się na automatycznych systemach w celu ograniczenia tych ryzyka.

Openai używa podobnego monitora rozumowania, aby zapobiec natywnego generatora obrazu GPT-4O przed tworzeniem materiałów seksualnych (CSAM). Jednak niektórzy badacze wzbudzili obawy, że Openai nie priorytetowo traktuje bezpieczeństwa tak bardzo, jak powinien, powołując się na ograniczony czas na przetestowanie O3 w odniesieniu do zwodniczego zachowania i brak raportu bezpieczeństwa dla dla bezpieczeństwa dla GPT-4.1.