Nowy model AI o nazwie S1, odsłonięte W artykule wydanym 2 lutego zwraca uwagę na opłacalne wyniki, które rywalizuje z O1 Openai, osiągając znaczne możliwości kosztem szkolenia zaledwie 6 USD.

Model AI S1 pojawia się jako opłacalna alternatywa dla O1 Openai

Model S1 osiąga poziomy wydajności w pobliżu najnowocześniejszego, wykorzystując prostszą infrastrukturę. Poprawia duże modele językowe (LLM) podczas wnioskowania poprzez wydłużenie „czasu myślenia” poprzez takie interwencje, jak zastąpienie tagów terminali na podpowiedzi takie jak „Poczekaj”.

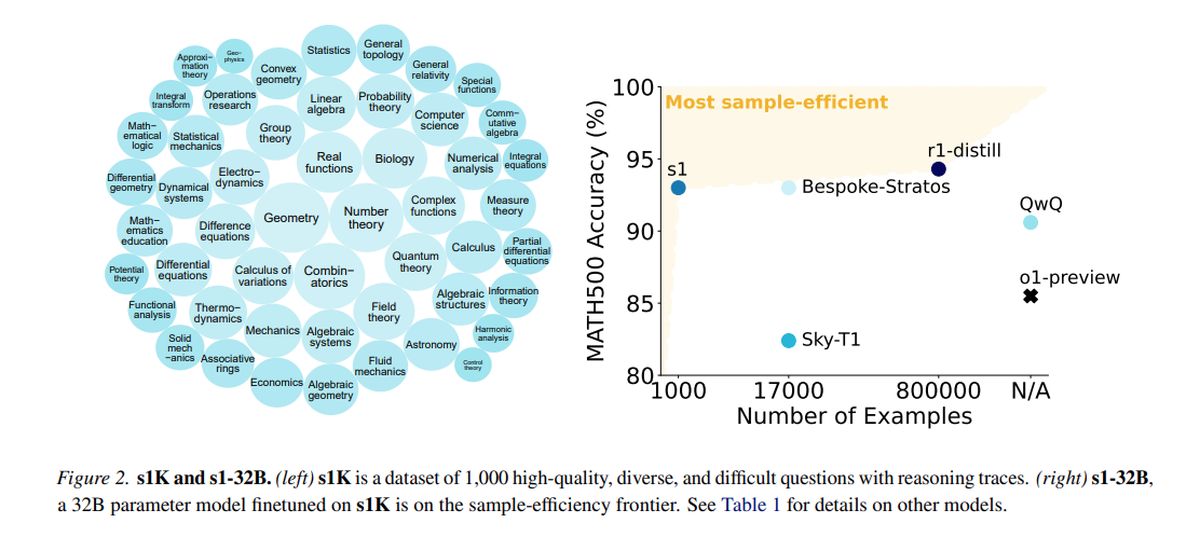

Przeszkoleni na destylowanym zestawie danych składających się z 1000 przykładów wysokiej jakości z QWEN2.5, opracowanego przez Alibaba Cloud, S1 zatrudnił 16 GPU NVIDIA H100, z jednym treningiem trwającym około 26 minut. Całkowity koszt obliczeniowy wyniósł około 6 USD, co pozwala na częstsze eksperymenty, nawet dla zespołów o ograniczonych zasobach.

Podczas gdy większe organizacje, takie jak Openai i Anthropic, zależą od obszernej infrastruktury, innowacje takie jak S1 wykazują potencjał postępu w ramach ograniczonych budżetów. Jednak wprowadzenie S1 wywołało obawy dotyczące „wyróżniania”, praktyki, w której modele wykorzystują destylowane zestawy danych z innych systemów AI, podnosząc pytania etyczne i prawne, które rozpaliły dyskusje branżowe.

W testach mierzących zdolności matematyki i kodowania S1 działa porównywalnie do wiodących modeli rozumowania, takich jak O1 Openai i R1 Deepseek. Model S1, w tym dane i kod szkolenia, jest dostępny w GitHub.

Zespół stojący za S1 rozpoczął się od modelu podstawowego i udoskonalił go za pomocą destylacji, metody wyodrębnienia możliwości rozumowania z istniejącego modelu AI przy użyciu jego odpowiedzi. W szczególności S1 jest destylowany z Google GEMINI 2.0 Flash Myślenie eksperymentalne, reprezentujące podobne podejście stosowane przez badaczy Berkeley do opracowania modelu rozumowania AI za około 450 USD w zeszłym miesiącu.

Zdolność mniejszych zespołów badawczych do wprowadzania innowacji w przestrzeni AI bez znacznego wsparcia finansowego stanowi zarówno emocje, jak i wyzwania. Powstaje pytanie o zrównoważony rozwój zalet zastrzeżonych w krajobrazie, w którym kosztowne modele można odtworzyć przystępność cenowo.

Openai wyraził niezadowolenie, twierdząc, że Deepseek niewłaściwie zebrał dane z API w celu destylacji modelowej. Naukowcy starali się opracować proste podejście, które osiągnie solidne rozumowanie i „skalowanie czasu testowego”, umożliwiając modele AI angażowanie się w głębszą analizę przed odpowiedzią.

Badania S1 wskazują, że modele rozumowania można destylować przy użyciu stosunkowo małego zestawu danych metodą zwaną nadzorowaną dopracowaniem (SFT), która instruuje model AI naśladowanie niektórych zachowań w zestawie danych. Ta metoda jest bardziej ekonomiczna niż podejście uczenia się wzmocnienia na dużą skalę wykorzystywane przez Deepseek dla swojego modelu R1.

Google zapewnia bezpłatny dostęp do eksperymentalnego myślenia Flash Gemini 2.0, choć użycie podlega dziennym limitom stawek, a jego warunki zabraniają modeli inżynierii odwrotnej w celu tworzenia konkurencyjnych usług. Proces szkoleniowy S1 polegał na kurtowaniu zestawu danych 1000 dostosowanych pytań i odpowiedzi wraz z procesami rozumowania pochodzącymi z Gemini 2.0.

Po treningu, który trwał mniej niż 30 minut, S1 wykazał dobre wyniki na określonych testach testowych AI. Niklas Muennighoff, badacz ze Stanford zaangażowany w projekt, wskazał, że niezbędne zasoby komputerowe można było dziś wynająć za około 20 USD.

Naukowcy wdrożyli również technikę zwiększającą dokładność S1, instruując ją do „czekania” podczas rozumowania, przedłużając czas myślenia i osiągając nieco ulepszone odpowiedzi.

Wyróżniony obraz obrazu: Google DeepMind/Unsplash