Przytulanie twarzy ma wydany Dwa nowe modele AI, SmolVLM-256M i SmolVLM-500M, twierdząc, że są najmniejszymi w swoim rodzaju, zdolnym do analizy obrazów, filmów i tekstu na urządzeniach z ograniczonym pamięcią RAM, takich jak laptopy.

Przytulanie twarzy uruchamia kompaktowe modele AI do analizy obrazu i tekstu

A Mały model językowy (SLM) to sieć neuronowa zaprojektowana do tworzenia tekstu języka naturalnego. Deskryptor „mały” dotyczy nie tylko fizycznych wymiarów modelu, ale także do jego liczby parametrów, struktury neuronowej i objętości danych używanych podczas treningu.

SmolvLM-256M i SmolVLM-500M składają się odpowiednio z 256 milionów parametrów i 500 milionów parametrów. Modele te mogą wykonywać różne zadania, w tym opisywanie zdjęć i klipów wideo, a także odpowiadać na pytania dotyczące plików PDF i ich zawartości, takie jak skanowany tekst i wykresy.

Sam Altman, aby poinformować urzędników w „Super AI na poziomie doktoranckim”

Aby wyszkolić te modele, Hisging Face wykorzystywał kalaretkę, wyselekcjonowaną kolekcję 50 wysokiej jakości zestawów danych obrazu i tekstu, obok Docmatix, zestawu danych zawierającego skanowanie plików ze szczegółowymi podpisami. Oba zestawy danych zostały stworzone przez zespół M4 Hulging Face, koncentrujący się na multimodalnych technologiach AI.

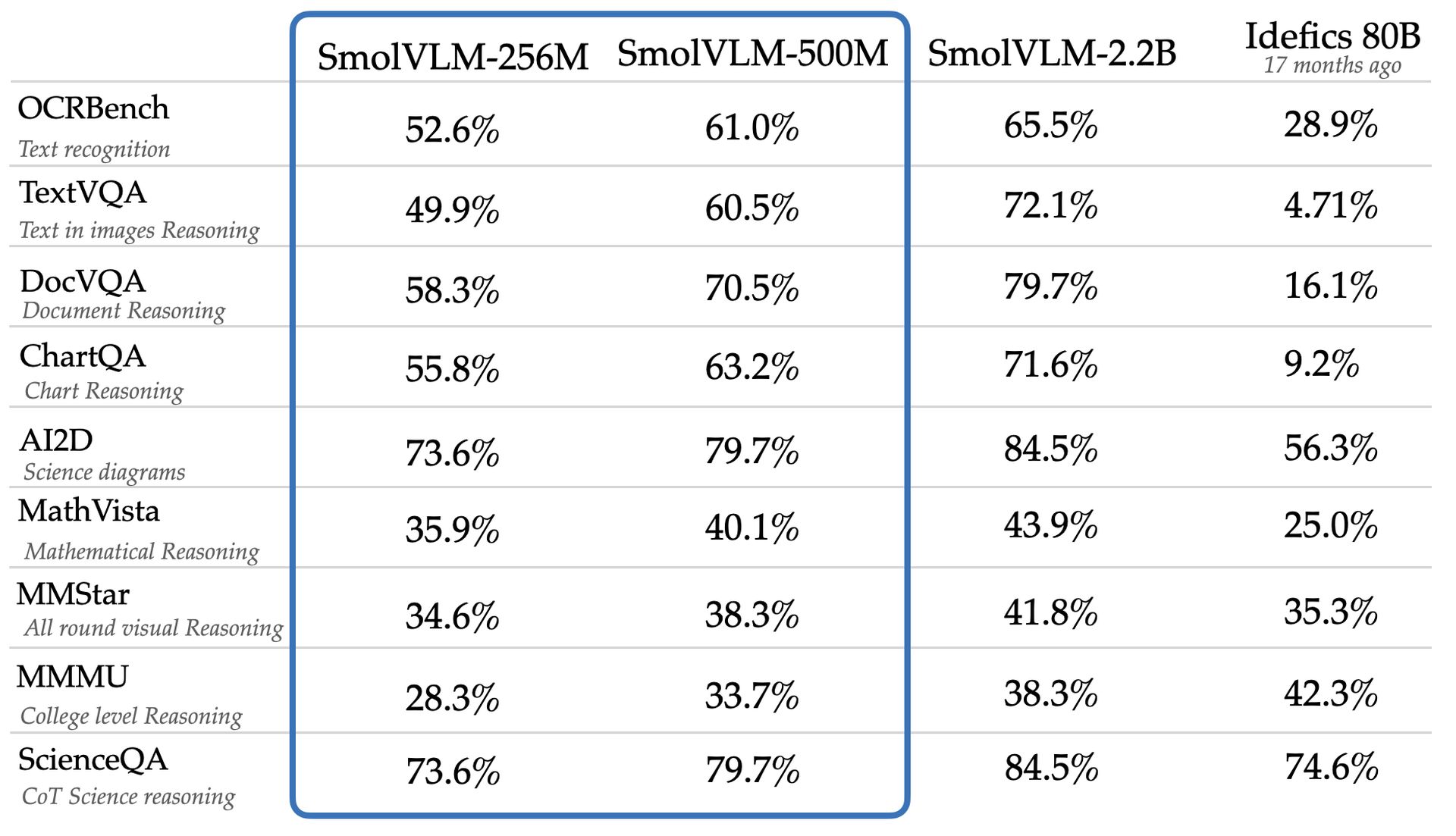

Zespół twierdzi, że SmolVLM-256M i SmolVLM-500M przewyższają znacznie większy model, IDEFICS 80B, w testach porównawczych, takich jak AI2D, który ocenia zdolności modeli do analizy schematów nauki na poziomie szkoły. Nowe modele są dostępne do dostępu do sieci i pobierania na licencji Apache 2.0, która umożliwia nieograniczone użycie.

Pomimo ich wszechstronności i opłacalności mniejsze modele, takie jak SmolVLM-256M i SmolVLM-500M, mogą wykazywać ograniczenia nieobserwowane w większych modelach. W badaniu Google Deepmind, Microsoft Research i MILA Research Institute podkreśliło, że mniejsze modele często wykonują nieoptymalnie złożone zadania rozumowania, potencjalnie ze względu na ich tendencję do rozpoznawania wzorców na poziomie powierzchni, a nie stosując wiedzę w nowych kontekstach.

Model SmolVLM-256M w Hugging Face działa z mniej niż jednym gigabajtem pamięci GPU i przewyższa model IDEFICS 80B, system o 300 razy większy, osiągając tę redukcję i ulepszenie w ciągu 17 miesięcy. Andrés Marafioti, inżynier badań nad uczeniem maszynowym w Hisging Face, zauważył, że osiągnięcie to odzwierciedla znaczące przełom w modelach w języku wizji.

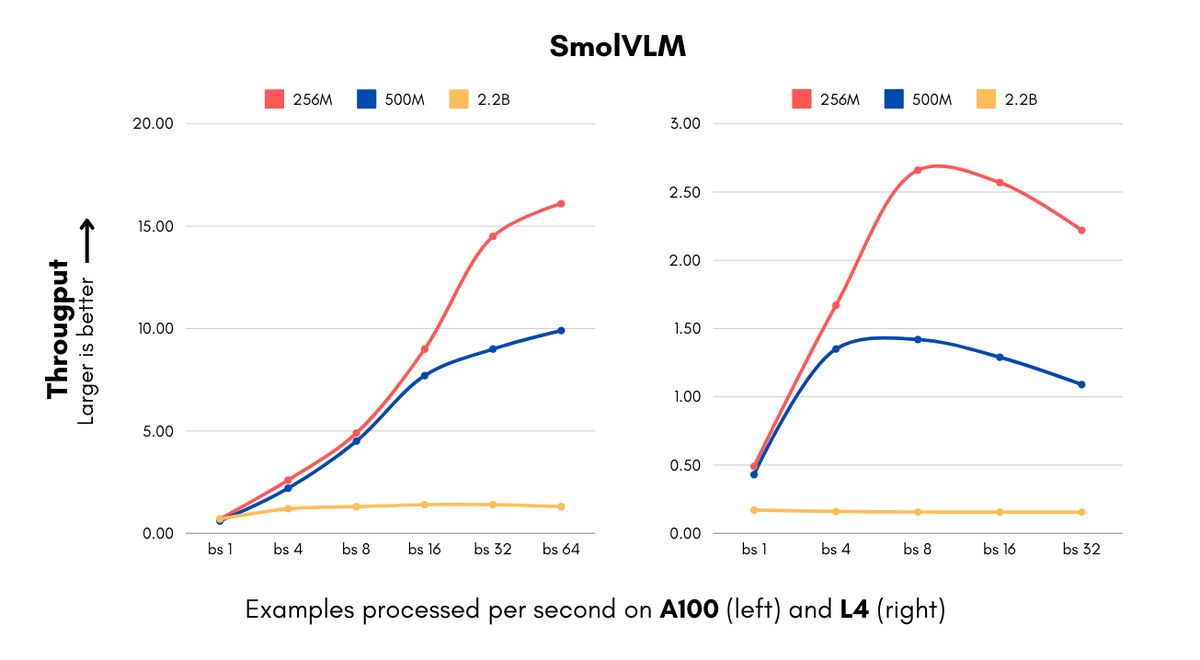

Wprowadzenie tych modeli dotyczy terminowych przedsiębiorstw, przed którymi stoją wysokie koszty obliczeniowe związane z implementacjami AI. Modele SmolvLM są w stanie przetwarzać obrazy i rozumieć treści wizualne z niespotykanymi prędkościami dla modeli ich wielkości. Wersja 256m może przetwarzać 16 przykładów na sekundę, zużywając tylko 15 GB pamięci RAM o wielkości partii 64, co prowadzi do znacznych oszczędności kosztów dla firm zajmujących się dużymi ilościami danych wizualnych.

IBM utworzył partnerstwo z Hulging Face w celu włączenia modelu 256M do oprogramowania do przetwarzania dokumentów, Docling. Jak wyjaśnił Marafioti, nawet organizacje o znacznych zasobach obliczeniowych mogą skorzystać z korzystania z mniejszych modeli do wydajnego przetwarzania milionów dokumentów po obniżonych kosztach.

Przytulanie twarzy osiągnęło redukcję wielkości przy jednoczesnym zachowaniu wydajności poprzez postępy zarówno w zakresie przetwarzania wizji, jak i języka, w tym przełącznik z enkodera wizji parametrów 400 m na wersję parametrów 93 m i zastosowanie agresywnych technik kompresji tokena. Ta wydajność otwiera nowe możliwości startupów i mniejszych przedsiębiorstw, umożliwiając im szybsze opracowywanie wyrafinowanych produktów wizji komputerowej i obniżenie kosztów infrastruktury.

Modele SmolVLM zwiększają możliwości poza oszczędnościami kosztów, ułatwiając nowe aplikacje, takie jak zaawansowane wyszukiwanie dokumentów za pośrednictwem algorytmu o nazwie colipali, który tworzy przeglądane bazy danych z archiwów dokumentów. Według Marafioti modele te prawie odpowiadają wydajności modeli 10-krotności ich wielkości, jednocześnie znacznie zwiększając szybkość tworzenia i wyszukiwania bazy danych, dzięki czemu wyszukiwanie wizualne w całym przedsiębiorstwie jest możliwe dla różnych firm.

Modele SmolVLM podważają konwencjonalne przekonanie, że większe modele są niezbędne do zaawansowanych zadań w języku wizji, a wersja parametrów 500m osiągnęła 90% wydajności parametru 2,2B parametrów na kluczowych testach porównawczych. Marafioti podkreślił, że rozwój ten pokazuje przydatność mniejszych modeli, co sugeruje, że mogą odgrywać kluczową rolę dla firm.

Wyróżniony obraz obrazu: Przytulanie twarzy