Według A BBC z raportu wynika, że nowo wydana platforma Apple AI, Apple Intelligence, spotkała się z ostrymi reakcjami po błędnym ogłoszeniu śmierci Luigiego Mangione, podejrzanego o morderstwo. Powiadomienie wysłane w zeszłym tygodniu za pośrednictwem iPhone’a podsumowało: BBC zgłosić nieprawidłowo, co doprowadzi do krytyki zarówno ze strony użytkowników, jak i organizacji medialnych. Ten incydent rodzi poważne pytania dotyczące wiarygodności i dokładności informacji generowanych przez sztuczną inteligencję.

Narzędzie AI firmy Apple błędnie zgłasza powiadomienie o śmierci podejrzanego o morderstwo

Firma Apple zintegrowała technologię Apple Intelligence ze swoimi systemami operacyjnymi, w tym iOS 18 i macOS Sequoia. Wśród swoich funkcji platforma oferuje generatywne narzędzia AI przeznaczone do pisania i tworzenia obrazów. Dodatkowo udostępnia funkcję kategoryzowania i podsumowywania powiadomień, mającą na celu ograniczenie rozpraszania użytkownika w ciągu dnia. Jednak niedawne fałszywe powiadomienie uwypukliło potencjalne nieścisłości i niedociągnięcia tej nowej funkcji, wprawiając użytkowników w zakłopotanie i zaniepokojenie integralnością udostępnianych informacji.

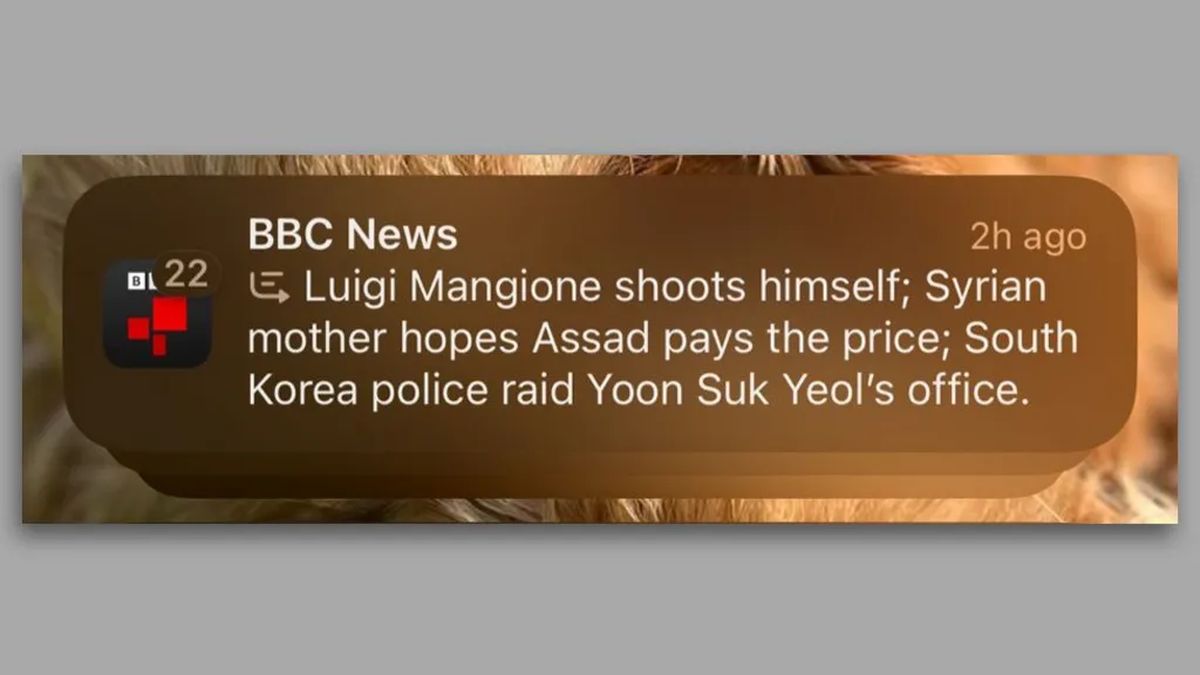

W powiadomieniu z 13 grudnia 2024 r. użytkownicy iPhone’a otrzymali wiadomość o treści „Luigi Mangione strzela do siebie” oraz dwa inne podsumowania najświeższych wiadomości. To błędne powiadomienie szybko zwróciło uwagę, zwłaszcza że zawierało błędną informację dotyczącą istotnego szczegółu dotyczącego Mangione, który jest oskarżony o zamordowanie 4 grudnia byłego dyrektora generalnego UnitedHealthcare, Briana Thompsona. BBCktóra nie opublikowała żadnych informacji o rzekomym zastrzeleniu Mangione, złożyła skargę do Apple. Od tego czasu sieć wezwała Apple do ponownego rozważenia swojego narzędzia generatywnej sztucznej inteligencji.

Wydaje się, że podstawowy problem wynika z modeli językowych (LLM) wykorzystywanych przez Apple Intelligence. Według UlicaKomninos Chatzipapas, dyrektor w Orion AI Solutions, „LLM takie jak GPT-4o… tak naprawdę nie mają żadnego wrodzonego zrozumienia, co jest prawdą, a co nie”. Modele te statystycznie przewidują kolejne słowa w oparciu o ogromne zbiory danych, jednak ta metoda może skutkować wiarygodnie brzmiącą treścią, która fałszywie przedstawia fakty. W tym przypadku Chatzipapas spekulował, że Apple mogło nieumyślnie wyszkolić swój model podsumowujący na podobnych przykładach, w których pojedyncze osoby strzelały do siebie, co dało mylący nagłówek.

Konsekwencje tego incydentu wykraczają poza wewnętrzne praktyki Apple. Reporterzy bez Granic wezwali firmę do usunięcia funkcji podsumowania, podkreślając powagę rozpowszechniania niedokładnych informacji powiązanych z renomowanymi mediami. Vincent Berthier z Reporterów bez Granic artykułowany obawy, że dezinformacja generowana przez sztuczną inteligencję szkodzi wiarygodności źródeł wiadomości. Stwierdził: „Sztuczna inteligencja to maszyny prawdopodobieństwa, a faktów nie można rozstrzygnąć na podstawie rzutu kostką”. Wzmacnia to argument, że modelom sztucznej inteligencji brakuje obecnie dojrzałości niezbędnej do zapewnienia wiarygodnego rozpowszechniania wiadomości.

Nie pozwól, aby sztuczna inteligencja czerpała korzyści z bólu i smutku rodzin

To wydarzenie nie jest odosobnione. Od czasu uruchomienia Apple Intelligence w USA w czerwcu użytkownicy zgłaszali dalsze nieścisłości, w tym powiadomienie o błędnym stwierdzeniu, że izraelski premier Benjamin Netanjahu został aresztowany. Chociaż Międzynarodowy Trybunał Karny wydał nakaz aresztowania Netanjahu, w powiadomieniu pominięto kluczowy kontekst, zamieszczając jedynie sformułowanie „Netanjahu aresztowany”.

Kontrowersje wokół Apple Intelligence ujawniają wyzwania związane z autonomią wydawców wiadomości w dobie sztucznej inteligencji. Chociaż niektóre organizacje medialne aktywnie korzystają z narzędzi sztucznej inteligencji do pisania i raportowania, użytkownicy funkcji Apple otrzymują streszczenia, które mogą fałszywie przedstawiać fakty, a wszystko to pod nazwą wydawcy. Zasada ta może mieć szersze konsekwencje dla sposobu zgłaszania i postrzegania informacji w epoce cyfrowej.

Firma Apple nie odpowiedziała jeszcze na zapytania dotyczące procesu przeglądu ani żadnych kroków, jakie zamierza podjąć w związku z BBC obawy. Obecny krajobraz technologii sztucznej inteligencji, ukształtowany w znacznym stopniu przez wprowadzenie platform takich jak ChatGPT, pobudził szybkie innowacje, ale tworzy także podatny grunt dla nieścisłości, które mogą wprowadzić opinię publiczną w błąd. W miarę kontynuowania badań nad treściami generowanymi przez sztuczną inteligencję i ich konsekwencjami, znaczenie zapewnienia niezawodności i dokładności staje się coraz ważniejsze.

Autor wyróżnionego obrazu: Maxima Hopmana/Unsplash