Sztuczna inteligencja szybko zajmuje swoje miejsce na rynku, penetrując nowe obszary zastosowań w sposób, którego nie mogliśmy sobie wyobrazić, w tym rozwiązania cyberbezpieczeństwa AI. Hype nie wykazuje oznak zaniku. Tak naprawdę nabiera to tempa nawet wśród kadry kierowniczej najwyższego szczebla. Powód jest jasny: potencjał sztucznej inteligencji w zakresie poprawy wydajności jest niemal nieograniczony.

Ale taki jest także potencjał zakłóceń. W dziedzinie cyberbezpieczeństwa stawka jest tak wysoka jak zawsze. Wykorzystanie sztucznej inteligencji jest widoczne po obu stronach barykad: zarówno przez atakujących, jak i obrońców.

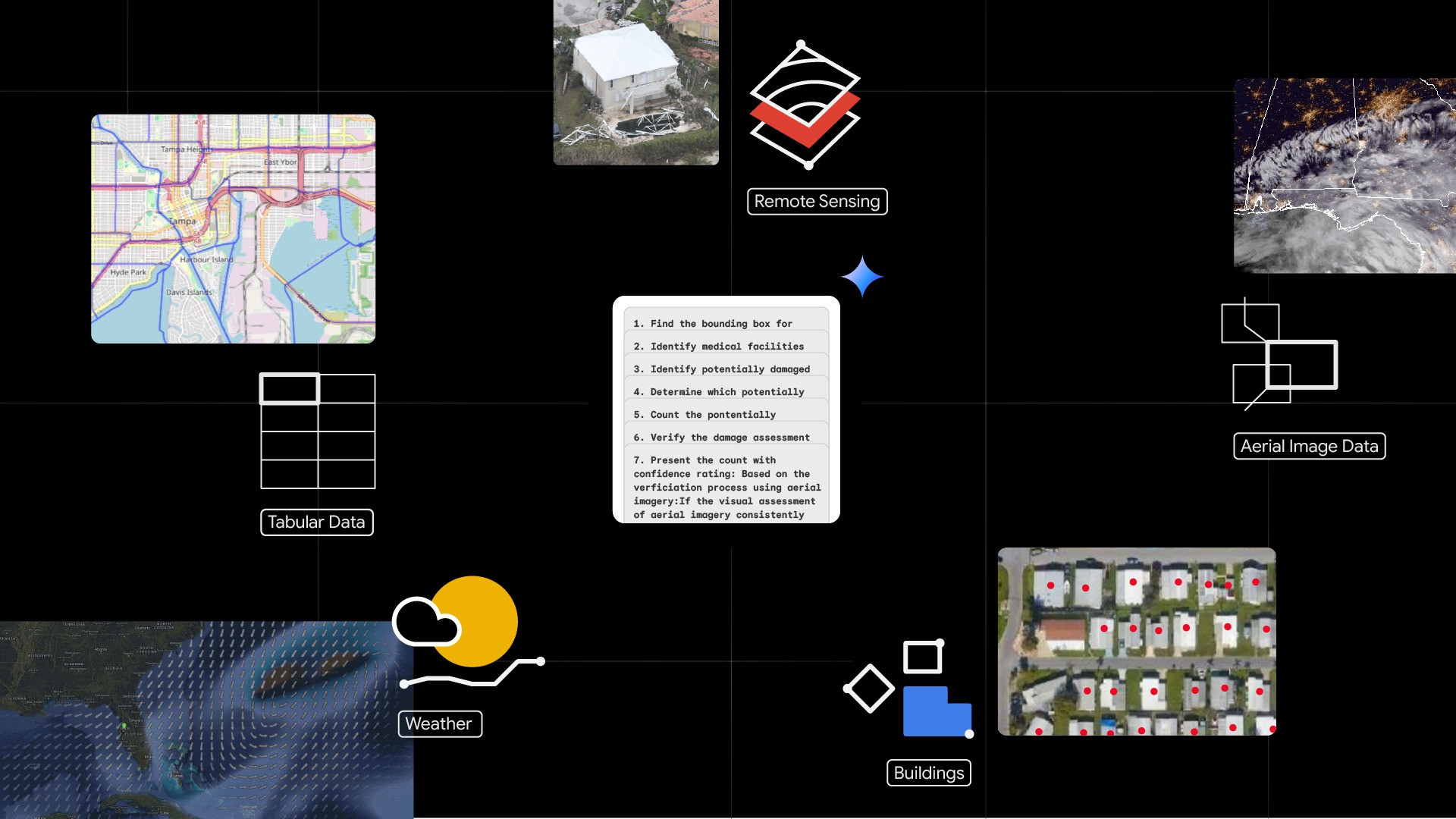

W tym artykule badam wpływ sztucznej inteligencji na obszar cyberbezpieczeństwa, opisuję potencjalne przypadki użycia i ich prawdopodobną skuteczność, omawiam wyzwania związane z samymi technologiami sztucznej inteligencji oraz zastanawiam się nad zagrożeniami, jakie sztuczna inteligencja stwarza dla stanowisk pracy specjalistów ds. cyberbezpieczeństwa.

Wyzwania związane z cyberbezpieczeństwem AI

Cyberbezpieczeństwo to dziedzina, która cieszy się dużym zainteresowaniem, nie tyle ze względu na jej skuteczność, ile ze względu na związane z nią wyzwania. W miarę ciągłego wzrostu liczby skutecznych cyberataków Amerykańska Agencja Rozwoju Międzynarodowego szacuje, że globalny koszt cyberprzestępczości wynosi 8 bilionów dolarów w 2023 rokuktóra ma wzrosnąć do 27 bilionów dolarów do 2027 r. Jednocześnie świat stoi w obliczu poważnego niedoboru specjalistów ds. cyberbezpieczeństwa.

Rośnie jednak obawa, że działające legalnie organizacje i cyberprzestępcy wdrażają technologie sztucznej inteligencji. Według ankiety przeprowadzonej przez Sapio Research i Deep Instinct, 75% specjalistów ds. cyberbezpieczeństwa zaobserwowało wzrost liczby cyberataków, a 85% uważa, że technologie sztucznej inteligencji prawdopodobnie przyczyniają się do tego wzrostu.

Rzeczywiście, napastnicy w coraz większym stopniu wykorzystują sztuczną inteligencję do wydajnego gromadzenia i przetwarzania informacji o swoich celach, przygotowywania kampanii phishingowych i opracowywania nowych wersji złośliwego oprogramowania, zwiększając moc i skuteczność swoich złośliwych działań. Tymczasem przyrost danych w cyfrowym świecie przekracza możliwości poznawcze człowieka, a talenty w dziedzinie cyberbezpieczeństwa nie mogą być rozwijane wystarczająco szybko ze względu na wysokie wymagania specjalistyczne. W miarę jak czynniki zewnętrzne zmieniają branżę, istniejące wyzwania stają się coraz większe w obliczu napływu danych i ataków.

Kontekst ludzki

Przedstawiamy najważniejszą słabość systemów cyberbezpieczeństwa: błąd ludzki. Wielokrotnie byliśmy świadkami naruszeń danych, w wyniku których systemy zaprojektowane do przetwarzania i przechowywania cennych informacji w chronionej sieci pozostawały niezabezpieczone i narażone na publiczny dostęp z powodu błędów konfiguracyjnych popełnionych przez personel.

Wydajność to kolejny problem związany z cyberbezpieczeństwem. Specjaliści nie są w stanie spójnie i bezbłędnie obsłużyć setek alertów dziennie, a zarządzanie procesami ręcznymi staje się coraz trudniejsze w miarę, jak sieci korporacyjne stają się coraz bardziej złożone i zróżnicowane, tak jak ma to miejsce obecnie.

Podobnie jak w innych branżach, cyberbezpieczeństwo w dużej mierze opiera się na interwencji człowieka. Specjaliści ds. cyberbezpieczeństwa weryfikują konfiguracje baz danych przed przetworzeniem cennych danych, skanują bazę kodu nowych aplikacji przed ich wydaniem, badają incydenty i identyfikują przyczyny źródłowe, między innymi. Nadszedł jednak także czas, abyśmy wykorzystali sztuczną inteligencję, aby poprawić wydajność i zapewnić obrońcom cyberbezpieczeństwa przewagę.

Przypadki użycia AI w cyberbezpieczeństwie

Zanim przejdziemy do konkretnych przypadków użycia, zdefiniujmy krótko wspomniane technologie, aby stworzyć podstawę do omówienia ich przypadków użycia.

Sztuczna inteligencja (AI) to dziedzina informatyki skupiona na tworzeniu systemów realizujących zadania wymagające ludzkiej inteligencji, takie jak przetwarzanie języka, analiza danych, podejmowanie decyzji i uczenie się. Służy jako dyscyplina nadrzędna, a inne obszary wchodzą w jej zakres.

Uczenie maszynowe (ML)podzbiór sztucznej inteligencji, umożliwia systemom uczenie się i doskonalenie na podstawie danych bez konieczności bezpośredniego programowania, a także podejmowanie decyzji w oparciu o wzorce i duże zbiory danych. Jest to obecnie najbardziej istotny obszar z punktu widzenia cyberbezpieczeństwa.

Głębokie uczenie się (DL)oddział ML, wykorzystuje sztuczne sieci neuronowe do modelowania złożonych relacji i rozwiązywania problemów z dużymi zbiorami danych. Ponieważ DL należy do ML, ta dyskusja skupi się przede wszystkim na uczeniu maszynowym.

- Obniżenie bariery wejścia

Bariera wejścia na tę dziedzinę jest znana z wysokich wymagań w zakresie wiedzy technicznej. Wczesne narzędzia, takie jak zapory ogniowe, korzystały z prostych reguł ruchu, ale w miarę jak sieci stawały się coraz bardziej złożone, tworzenie i sprawdzanie tych reguł stawało się coraz większym wyzwaniem.

Sztuczna inteligencja może uprościć ten proces, pisząc dokładne reguły, zapewniając jednocześnie specjalistom interfejs, taki jak system czatu przetwarzający język naturalny. Specjalista ds. cyberbezpieczeństwa mógłby opisać, jaki ruch należy zezwolić lub zablokować, oraz warunki, w jakich powinny obowiązywać określone zasady, a sztuczna inteligencja wygenerowałaby zasady do odczytu maszynowego, zapewniając odpowiednią składnię i semantykę. Usprawnia to opracowywanie reguł, czyniąc pole bardziej dostępnym i zmniejszając wysiłek wymagany do zarządzania bezpieczeństwem.

- Inwentaryzacja zasobów i mapowanie ścieżek ataku

W miarę jak sieci korporacyjne stają się coraz bardziej złożone i ewoluują w środowiska hybrydowe i wielochmurowe z globalnymi punktami obecności, zarządzanie nimi i ich zabezpieczanie staje się dużym wyzwaniem. Nowoczesne sieci mogą również skalować się automatycznie w zależności od zapotrzebowania, co jeszcze bardziej utrudnia inwentaryzację zasobów, identyfikowanie zagrożeń i modelowanie potencjalnych ścieżek ataku.

Sztuczna inteligencja może pomóc w tych zadaniach, stale skanując sieci, katalogując zasoby i dodając spostrzeżenia kontekstowe. Dzięki zdolności uczenia się na danych sztuczna inteligencja już przewyższa ludzi w prognozowaniu i może analizować architektury sieciowe w celu identyfikacji potencjalnych łańcuchów ataków. Pomaga to zespołom ds. cyberbezpieczeństwa ustalić priorytety wysiłków i przenieść punkt ciężkości ze środków reaktywnych na ochronę proaktywną. Dzięki sztucznej inteligencji staje się wyraźniejsze, które luki w zabezpieczeniach mogą wykorzystać napastnicy i jak je skutecznie wzmocnić.

- Zarządzanie lukami w zabezpieczeniach

Złożoność zarządzania lukami w zabezpieczeniach rośnie wraz ze wzrostem rozmiaru i złożoności sieci korporacyjnych, liczby zidentyfikowanych luk, dostępnych exploitów i wskaźników oceny podatności. Uruchomienie programu do zarządzania podatnościami w dużej sieci może przypominać szukanie igły w stogu siana dla specjalistów od cyberbezpieczeństwa. Tradycyjne skanery podatności często generują ogromne raporty zawierające tysiące luk o różnej wadze, którym towarzyszą zalecenia dotyczące środków zaradczych, które mogą nie mieć znaczenia bez kontekstu biznesowego i aplikacyjnego.

Sztuczna inteligencja może odegrać kilka kluczowych ról w tym procesie, wspierając profesjonalistów:

- Korelowanie danych o podatnościach z informacjami o exploitach i powiązanych atakach.

- Wzbogacanie danych o podatnościach systemu o kontekst biznesowy.

- Priorytetyzacja luk w zabezpieczeniach w celu naprawy i automatyzacji wdrażania poprawek.

Luki dnia zerowego stanowią dodatkowe wyzwanie, ale sztuczna inteligencja może pomóc, analizując duże ilości informacji w celu zidentyfikowania i śledzenia luk dnia zerowego w różnych technologiach.

4. Wykrywanie i analiza złośliwego oprogramowania

Złośliwe oprogramowanie stanowi podstawę współczesnych cyberataków, a jego liczba rośnie wraz ze wzrostem grup cyberprzestępczych, liczbą ataków i budżetami atakujących. Cyberprzestępcy wykorzystują zaawansowane techniki, aby ulepszać złośliwe oprogramowanie i unikać wykrycia. Niektóre nawet wykorzystują sztuczną inteligencję do szybszego i wydajniejszego opracowywania nowych próbek złośliwego oprogramowania.

Sztuczna inteligencja może pomóc, identyfikując złośliwe oprogramowanie na podstawie analizy behawioralnej i pomagając w inżynierii wstecznej, podczas której specjaliści analizują złośliwe oprogramowanie w celu ulepszenia zabezpieczeń. W inżynierii wstecznej sztuczna inteligencja może pełnić rolę konsultanta, wyjaśniając segmenty kodu i możliwe intencje stojące za wyborami twórców szkodliwego oprogramowania, usprawniając proces analizy dla specjalistów ds. cyberbezpieczeństwa.

5. Monitorowanie zagrożeń i ataków

Cyberataki stają się coraz częstsze, bardziej złożone i szybsze. To, co kiedyś zajmowało miesiące, teraz zajmuje sekundy. Współcześni napastnicy poruszają się bocznie, kradną dane i usuwają ślady, dzięki czemu mogą wybrać większą liczbę ofiar i zmaksymalizować swój wpływ. Takie zachowanie zalewa zespoły zajmujące się cyberbezpieczeństwem alertami, co sprawia, że w tej złożonej grze decydującym czynnikiem jest szybka reakcja.

Jednak wiele z nich daje wyniki fałszywie dodatnie, co prowadzi do zmęczenia wśród profesjonalistów. W miarę rozwoju sieci i danych ręczna analiza logów nie jest już możliwa, szczególnie w obliczu ciągłego niedoboru wykwalifikowanych specjalistów ds. cyberbezpieczeństwa.

Dlatego najlepszym rozwiązaniem jest delegowanie ciągłego monitorowania sieci i wykrywania zagrożeń do sztucznej inteligencji oraz automatyzacja reakcji na wskaźniki ataku. Na szczęście większość cyberataków opiera się na wspólnych wzorcach, których sztuczna inteligencja może się nauczyć, umożliwiając błyskawiczne reakcje i wyprzedzenie atakujących. Sztuczna inteligencja działa bez zmęczenia 24 godziny na dobę, 7 dni w tygodniu, szybko dostosowuje się do nowych danych, ogranicza liczbę fałszywych alarmów i może generować zalecenia dotyczące środków zapobiegawczych w przypadku znalezienia śladów ataku, zakrywając luki, które mogliby przeoczyć specjaliści. W najlepszym razie wymarzony partner.

6. Ochrona przed phishingiem

Jedną z cech ludzkich, która osłabia korporacyjne systemy cyberbezpieczeństwa, jest nasza skłonność do działania pod wpływem emocji. Cyberprzestępcy wykorzystują tę lukę poprzez inżynierię społeczną, w szczególności phishing, wykorzystując pracowników jako punkty wejścia do sieci korporacyjnych.

Aby ataki były skuteczniejsze, napastnicy coraz częściej wykorzystują sztuczną inteligencję do tworzenia bardziej przekonujących wiadomości e-mail phishingowych i atakowania większej liczby ofiar. W odpowiedzi specjaliści ds. cyberbezpieczeństwa mogą chronić pracowników przed atakami phishingowymi, ucząc modele sztucznej inteligencji na dużych zbiorach danych znanych technik inżynierii społecznej.

7. Monitorowanie zachowań i wykrywanie zagrożeń wewnętrznych

Ochrona przed zagrożeniami wewnętrznymi jest nadal jednym z największych wyzwań cyberbezpieczeństwa. Insiderzy mają legalny dostęp do systemów korporacyjnych, co utrudnia wykrycie.

Systemy oparte na sztucznej inteligencji mogą automatycznie identyfikować podejrzane działania, takie jak nieautoryzowany dostęp do wrażliwych danych lub próby kradzieży danych. Wykorzystując uczenie maszynowe, sztuczna inteligencja dostosowuje się do zmian w zachowaniu pracowników, ograniczając liczbę fałszywych alarmów. Ponadto sztuczna inteligencja pomaga przewidywać ryzyko, analizując dane historyczne i identyfikując wzorce sygnalizujące potencjalnie złośliwe działania pracowników.

8. Ulepszone wyszukiwanie zdarzeń związanych z cyberbezpieczeństwem

Google to podstawa w świecie wyszukiwarek, oferująca wyniki, na których wszyscy polegamy. Jednak wyniki wyszukiwania często przypominają bardziej spis treści niż zwięzłe podsumowanie punktów krytycznych. Dla specjalistów ds. cyberbezpieczeństwa posiadanie ulepszonego narzędzia wyszukiwania może mieć ogromne znaczenie w walce z cyberzagrożeniami.

Prosty „spis treści” nie wystarczy, gdy specjaliści potrzebują szczegółowego wglądu w stan chronionej sieci korporacyjnej. Systemy oparte na sztucznej inteligencji mogą wkroczyć, aby ulepszyć tradycyjne możliwości wyszukiwania, zapewniając krytyczny kontekst niezbędny do podejmowania świadomych decyzji i skutecznego reagowania na zagrożenia.

9. Minimalizowanie błędu ludzkiego

Zarządzanie tysiącami hostów przy jednoczesnym przestrzeganiu zasad bezpieczeństwa może być przytłaczające. W tym przypadku sztuczna inteligencja może pomóc, ucząc się na prawidłowych konfiguracjach i błędach z przeszłości, identyfikując błędy i oznaczając je w czasie rzeczywistym. Ponadto sztuczna inteligencja może proaktywnie generować konfiguracje hostów w oparciu o opisy funkcjonalności zapewnianych przez człowieka.

Przyjmij zmianę

Chociaż skok w kierunku w pełni autonomicznych systemów sztucznej inteligencji wydaje się stosunkowo mało prawdopodobny, sztuczna inteligencja może potencjalnie uzupełnić ludzką wiedzę, umożliwiając profesjonalistom radzenie sobie z najpilniejszymi problemami w tej dziedzinie. Kluczem do uwolnienia potencjału sztucznej inteligencji jest posiadanie wykwalifikowanych specjalistów, którzy rozumieją, jak ona działa, oraz stosują kreatywność i krytyczne myślenie, aby uczynić technologię jeszcze bardziej skuteczną.

W historii każdy większy przełom technologiczny wywoływał strach i niepewność. Jednak z biegiem czasu nauczyliśmy się dostosowywać, wykorzystywać te narzędzia i skutecznie z nich korzystać, równoważąc ich możliwości z naszymi ograniczeniami. Czas zrobić to samo ze sztuczną inteligencją: zintegrować ją z cyberbezpieczeństwem i delegować zadania tam, gdzie sztuczna inteligencja działa lepiej niż my.