OpenAI Orion, model sztucznej inteligencji nowej generacji firmy, uderza w bariery wydajności, które obnażają ograniczenia tradycyjnych podejść do skalowania. Źródła zaznajomione ze sprawą ujawniają, że Orion zapewnia mniejszy wzrost wydajności niż jego poprzednicy, co skłoniło OpenAI do ponownego przemyślenia swojej strategii rozwoju.

Wczesne testy ujawniają utrzymującą się poprawę

Wstępne testy pracowników na to wskazują OpenAI Orion osiągnął poziom GPT-4 po ukończeniu zaledwie 20% szkolenia. Choć może to brzmieć imponująco, należy pamiętać, że wczesne etapy szkolenia AI zazwyczaj przynoszą najbardziej dramatyczną poprawę. Jest mało prawdopodobne, aby pozostałe 80% szkoleń przyniosło znaczące postępy, co sugeruje, że OpenAI Orion może nie przewyższyć GPT-4 w dużym stopniu.

„Niektórzy badacze w firmie uważają, że Orion nie jest w sposób niezawodny lepszy od swojego poprzednika w wykonywaniu niektórych zadań” – stwierdził Informacje. „Według pracownika OpenAI „Orion radzi sobie lepiej z zadaniami językowymi, ale może nie przewyższać poprzednich modeli w zadaniach takich jak kodowanie”.

Dylemat niedoboru danych

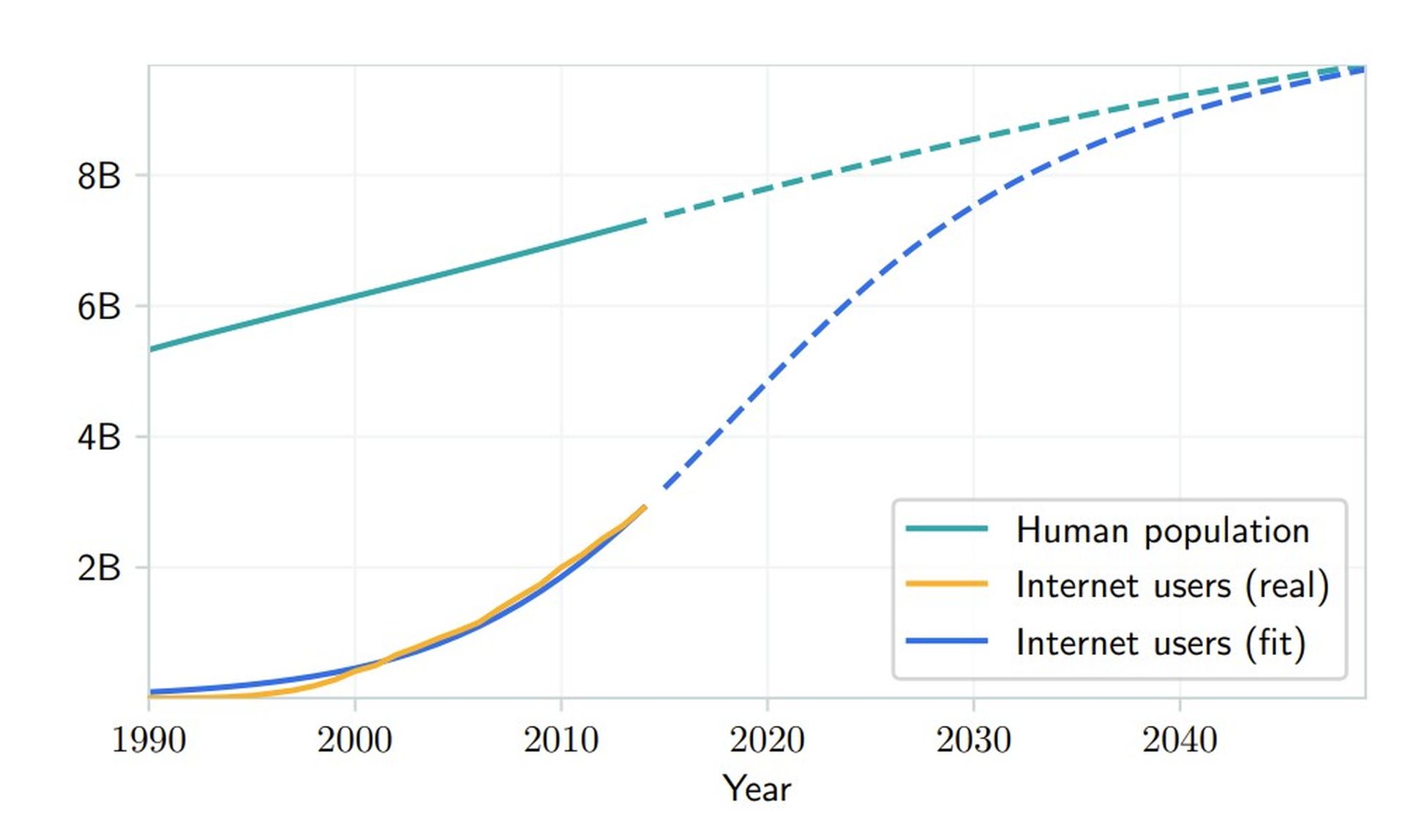

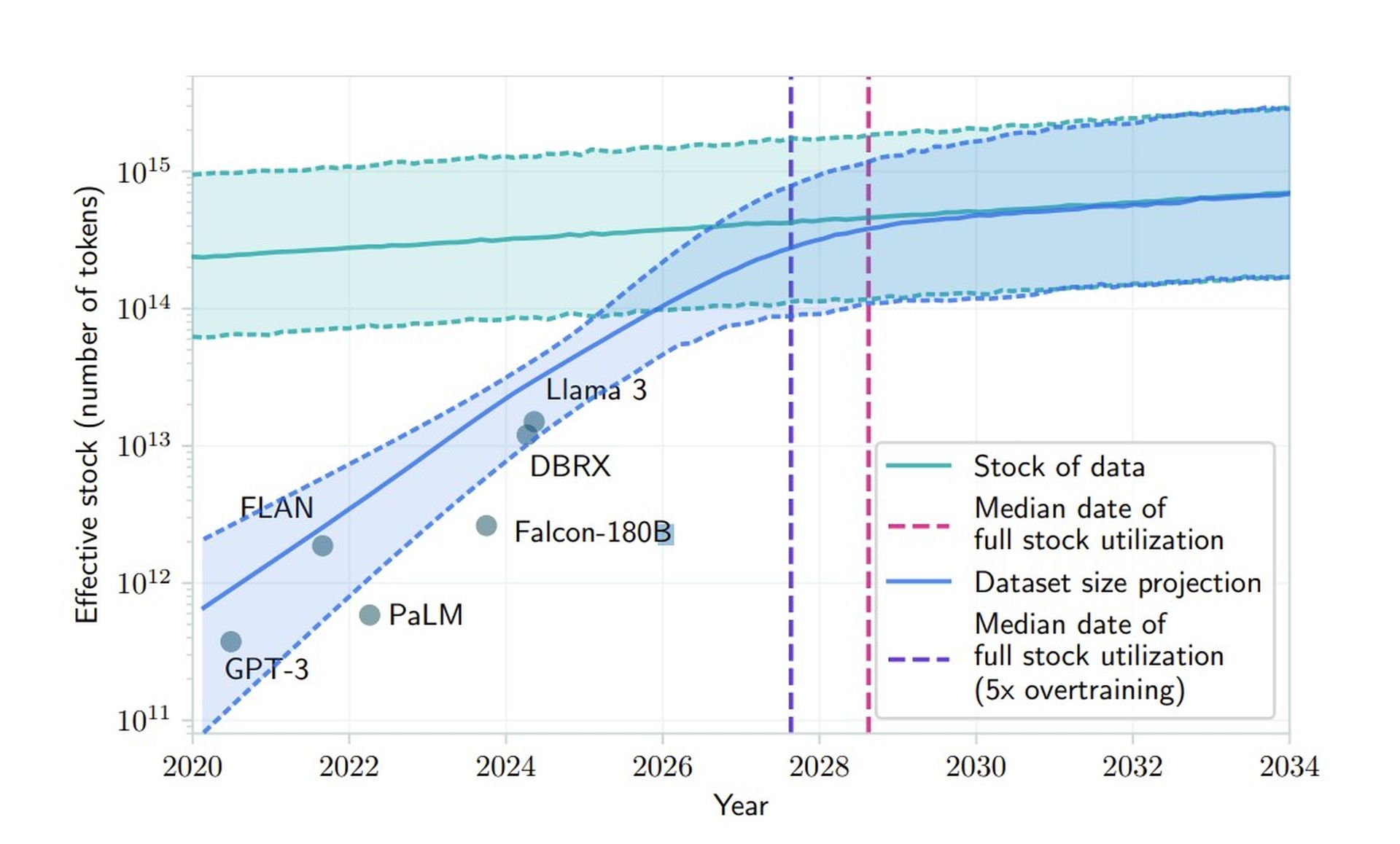

Wyzwania OpenAI związane z Orionem uwydatniają podstawowy problem w branży AI: malejącą podaż wysokiej jakości danych szkoleniowych. Badania opublikowane w czerwcu przewidują, że firmy zajmujące się sztuczną inteligencją wyczerpią dostępne publiczne dane tekstowe generowane przez człowieka w latach 2026–2032. Ten niedobór stanowi krytyczny punkt zwrotny dla tradycyjnych podejść do rozwoju, zmuszając firmy takie jak OpenAI do poszukiwania alternatywnych metod.

„Nasze ustalenia wskazują, że obecnych trendów w rozwoju LLM nie da się utrzymać wyłącznie za pomocą konwencjonalnego skalowania danych” – czytamy w badaniu stany papieru. Podkreśla to potrzebę generowania danych syntetycznych, uczenia się poprzez transfer i wykorzystywania danych niepublicznych w celu poprawy wydajności modelu.

Dwutorowa strategia rozwoju OpenAI

Aby stawić czoła tym wyzwaniom, OpenAI restrukturyzuje swoje podejście, rozdzielając rozwój modelu na dwie odrębne ścieżki. Seria O, o nazwie kodowej Strawberry, koncentruje się na możliwościach rozumowania i reprezentuje nowy kierunek w architekturze modeli. Modele te działają ze znacznie większą intensywnością obliczeniową i są specjalnie zaprojektowane do złożonych zadań rozwiązywania problemów.

Równolegle modele Oriona – czyli seria GPT – wciąż ewoluują, koncentrując się na ogólnych zadaniach związanych z przetwarzaniem języka i komunikacją. Dyrektor ds. produktów OpenAI, Kevin Weil, potwierdził tę strategię podczas AMA, stwierdzając: „To nie jest albo albo, to jedno i drugie — lepsze modele podstawowe plus więcej skalowania/czasu wnioskowania truskawek”.

Dane syntetyczne: Miecz obosieczny

OpenAI bada syntetyczne generowanie danych, aby rozwiązać problem niedoboru danych dla OpenAI Orion. Rozwiązanie to wprowadza jednak nowe komplikacje w utrzymaniu jakości i niezawodności modelu. Modele szkoleniowe na treściach generowanych przez sztuczną inteligencję mogą prowadzić do powstania pętli sprzężenia zwrotnego, które wzmacniają subtelne niedoskonałości, tworząc efekt złożony, który jest coraz trudniejszy do wykrycia i skorygowania.

Naukowcy odkryli, że poleganie w dużym stopniu na danych syntetycznych może z czasem powodować degradację modeli. Zespół OpenAI Foundations opracowuje nowe mechanizmy filtrowania w celu utrzymania jakości danych, wdrażając techniki walidacji w celu odróżnienia wysokiej jakości od potencjalnie problematycznych treści syntetycznych. Badają także hybrydowe podejścia do szkoleń, które łączą treści generowane przez ludzi i sztuczną inteligencję, aby zmaksymalizować korzyści przy jednoczesnej minimalizacji wad.

OpenAI Orion jest wciąż na wczesnym etapie i czeka go wiele prac rozwojowych. Dyrektor generalny Sam Altman wskazał, że nie będzie on gotowy do wdrożenia w tym roku ani w następnym. Ten wydłużony harmonogram może okazać się korzystny, umożliwiając naukowcom wyeliminowanie bieżących ograniczeń i odkrycie nowych metod ulepszania modelu.

W obliczu podwyższonych oczekiwań po niedawnej rundzie finansowania w wysokości 6,6 miliarda dolarów OpenAI zamierza stawić czoła tym wyzwaniom, wprowadzając innowacje w swojej strategii rozwoju. Stawiając czoła dylematowi niedoboru danych, firma ma nadzieję zapewnić, że OpenAI Orion wywrze znaczący wpływ na jego ostateczną premierę.

Autor wyróżnionego obrazu: Jonathana Kempera/Unsplash