Allen Institute for AI (Ai2) upublicznił Molmo, innowacyjny zestaw multimodalnych modeli open-source, które kwestionują przewodni wpływ zastrzeżonych systemów AI. Dzięki mocnym stronom w zakresie doskonałego rozpoznawania obrazu i praktycznych spostrzeżeń, Molmo jest gotowe pomóc deweloperom, badaczom i startupom, dostarczając zaawansowane, ale łatwe w użyciu narzędzie do tworzenia aplikacji AI. Wprowadzenie na rynek zwraca uwagę na ważną zmianę w krajobrazie AI, łącząc modele open-source i zastrzeżone oraz poprawiając dostęp wszystkich do wiodących technologii AI.

Molmo oferuje funkcje zapewniające wyjątkowy stopień zrozumienia obrazu, co pozwala mu poprawnie odczytywać szeroką gamę danych wizualnych — od banalnych elementów po złożone wykresy i menu. Zamiast być jak większość Modele sztucznej inteligencjiMolmo przewyższa percepcję, umożliwiając użytkownikom interakcję z wirtualnymi i rzeczywistymi środowiskami poprzez wskazywanie i szereg działań przestrzennych. Ta możliwość oznacza przełom, umożliwiający wprowadzenie złożonych agentów AI, robotyki i wielu innych aplikacji, które zależą od szczegółowego zrozumienia danych wizualnych i kontekstowych.

Wydajność i dostępność stanowią główne aspekty strategii rozwoju Molmo. Zaawansowane umiejętności Molmo pochodzą z zestawu danych zawierającego mniej niż milion obrazów, co stanowi jaskrawy kontrast z miliardami obrazów przetwarzanych przez inne modele, takie jak GPT-4V i Google BliźniętaWdrożone podejście przyczyniło się do tego, że Molmo jest nie tylko wysoce wydajny w wykorzystaniu zasobów obliczeniowych, ale także stworzył model, który jest równie wydajny jak najskuteczniejsze zastrzeżone systemy i charakteryzuje się mniejszą liczbą halucynacji oraz szybszymi wskaźnikami szkolenia.

Uczynienie Molmo w pełni otwartym kodem źródłowym jest częścią większego strategicznego wysiłku Ai2 na rzecz demokratyzacji rozwoju AI. Ai2 umożliwia szerokiej gamie użytkowników — od startupów po laboratoria akademickie — wprowadzanie innowacji i rozwój w technologii AI bez wysokich kosztów inwestycji lub ogromnej mocy obliczeniowej. Daje im dostęp do danych szkoleniowych języka i wizji Molmo, wag modeli i kodu źródłowego.

Matt Deitke, badacz z Allen Institute for AI, powiedział: „Molmo to niesamowity model AI z wyjątkowym zrozumieniem wizualnym, który przesuwa granice rozwoju AI, wprowadzając paradygmat interakcji AI ze światem poprzez wskazywanie. Wydajność modelu jest napędzana przez niezwykle wysokiej jakości zbiór danych, który uczy AI rozumienia obrazów za pomocą tekstu. Szkolenie jest o wiele szybsze, tańsze i prostsze niż to, co robi się dzisiaj, tak że otwarte wydanie sposobu jego budowy umożliwi całej społeczności AI, od startupów po laboratoria akademickie, pracę na granicy rozwoju AI”.

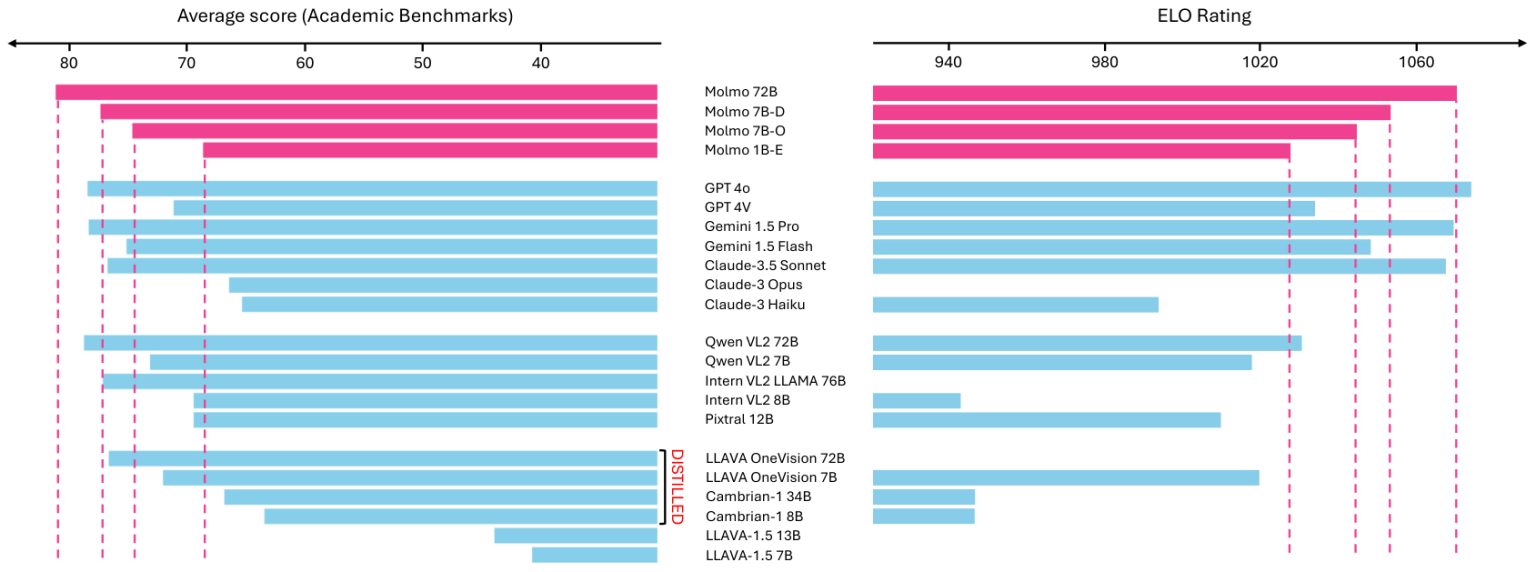

Według wewnętrznych ocen, największy model Molmo, mający 72 miliardy parametrów, przewyższył OpenAI’s GPT-4V i innych czołowych konkurentów w kilku testach porównawczych. Najmniejszy model Molmo, mający tylko miliard parametrów, jest wystarczająco duży, aby działać na urządzeniu mobilnym, a jednocześnie przewyższa modele z dziesięciokrotnie większą liczbą parametrów. Tutaj możesz zobaczyć modele i spróbuj sam.