Reflection 70B to duży model językowy (LLM) opracowany przez HyperWrite, startup zajmujący się pisaniem AI. Zbudowany na Meta Llama 3.1-70B Instruct, Reflection 70B to nie tylko kolejny model typu open source. Jego innowacyjny mechanizm autokorekty wyróżnia go, umożliwiając mu prześcignięcie wielu istniejących modeli i liczenie „r” w truskawkach.

Technika napędzająca Reflection 70B jest prosta, ale bardzo skuteczna.

Obecni absolwenci studiów prawniczych mają skłonność do halucynacji i nie są w stanie rozpoznać, kiedy im się to przytrafia.

Reflection-Tuning umożliwia absolwentom LLM-ów rozpoznawanie swoich błędów i korygowanie ich przed udzieleniem odpowiedzi. fot.twitter.com/pW78iXSwwb

— Matt Shumer (@mattshumer_) 5 września 2024 r.

Poczekaj, dlaczego Llama 3.1-70B jest bazą dla HyperWrite Reflection 70B?

Reflection 70B jest zbudowany na Instrukcja do Meta’s Llama 3.1-70Bpotężny model bazowy zaprojektowany do różnych zadań językowych. Modele Llama są znane ze swojej skalowalności i wysokiej wydajności, ale Reflection 70B idzie dalej, wprowadzając szereg udoskonaleń, szczególnie w rozumowaniu i korekcji błędów.

Powód? Bazując na oprogramowaniu open source, Llama 3.1-70B pozwala deweloperom na dostrajanie, adaptowanie i dostosowywanie modelu. Modele Llama są trenowane na ogromnych ilościach zróżnicowanych danych, co pozwala im na doskonałe wykonywanie zadań ogólnego przeznaczenia, takich jak generowanie języka, odpowiadanie na pytania i podsumowywanie.

Reflection 70B opiera się na tych solidnych podstawach i tworzy bardziej wyrafinowany system wykrywania błędów, który radykalnie poprawia jego możliwości wnioskowania.

Meta nie jest jedynym pomocnikiem HyperWrite; poznaj Glaive

Kluczowym elementem sukcesu Reflection 70 B jest jego syntetyczne dane treningowe dostarczone przez Glewiastartup specjalizujący się w tworzeniu niestandardowych zestawów danych do konkretnych zadań. Generując syntetyczne dane dostosowane do konkretnych przypadków użycia, Glaive pozwolił zespołowi Reflection szybko szkolić i dostrajać swój model, osiągając wyższą dokładność w krótszym czasie.

Współpraca z Glaive umożliwiła szybkie tworzenie wysokiej jakości zestawów danych w ciągu godzin zamiast tygodni, przyspieszając cykl rozwoju Reflection 70B. Ta synergia między architekturą modelu a danymi szkoleniowymi pokazuje potencjał innowacyjnych partnerstw w AI

Gdzie jest HyperWrite Reflection 70B Shine?

Cechą charakterystyczną Reflection 70B jest jego zdolność do samokorygowaniaDuże modele językowe (LLM) często generują tekst, który może być niepoprawny lub niespójny, zjawisko znane jako Halucynacje AI. Błędy te są dobrze znanym ograniczeniem LLM, nawet wśród liderów branży, takich jak seria GPT OpenAI. Reflection 70B rozwiązuje ten problem za pomocą unikalnej techniki „dostrajania odbicia”.

Czym jest strojenie odbiciowe?

Strojenie odbicia umożliwia modelowi ocenę własnego wyjścia pod kątem błędów logicznych i ich korektę przed przedstawieniem ostatecznej odpowiedzi. Mechanizm ten opiera się na warstwowym procesie rozumowania:

- Rozumowanie krok po kroku:Podczas wnioskowania (gdy model generuje odpowiedź) Reflection 70B rozbija swój proces myślowy na odrębne kroki. „Myśli na głos”, ujawniając, w jaki sposób dochodzi do odpowiedzi, podobnie jak osoba rozwiązująca złożony problem.

- Wykrywanie błędów:Model wprowadza specjalne tokeny podczas rozumowania, które pomagają monitorować postęp. Te tokeny działają jak flagi, kierując modelem do ponownego odwiedzania i ponownej analizy sekcji, które wydają się logicznie niespójne lub niepoprawne.

- Samokorekta: Po zidentyfikowaniu błędu model podejmuje działania naprawcze, generując poprawioną odpowiedź. Proces ten odbywa się w czasie rzeczywistym, zapewniając, że wynik jest tak dokładny, jak to możliwe.

Dzięki integracji tych funkcji Reflection 70B naśladuje pewien rodzaj metapoznanie—myśląc o swoim własnym myśleniug — czego brakuje większości programów LLM, w tym ChatGPT!

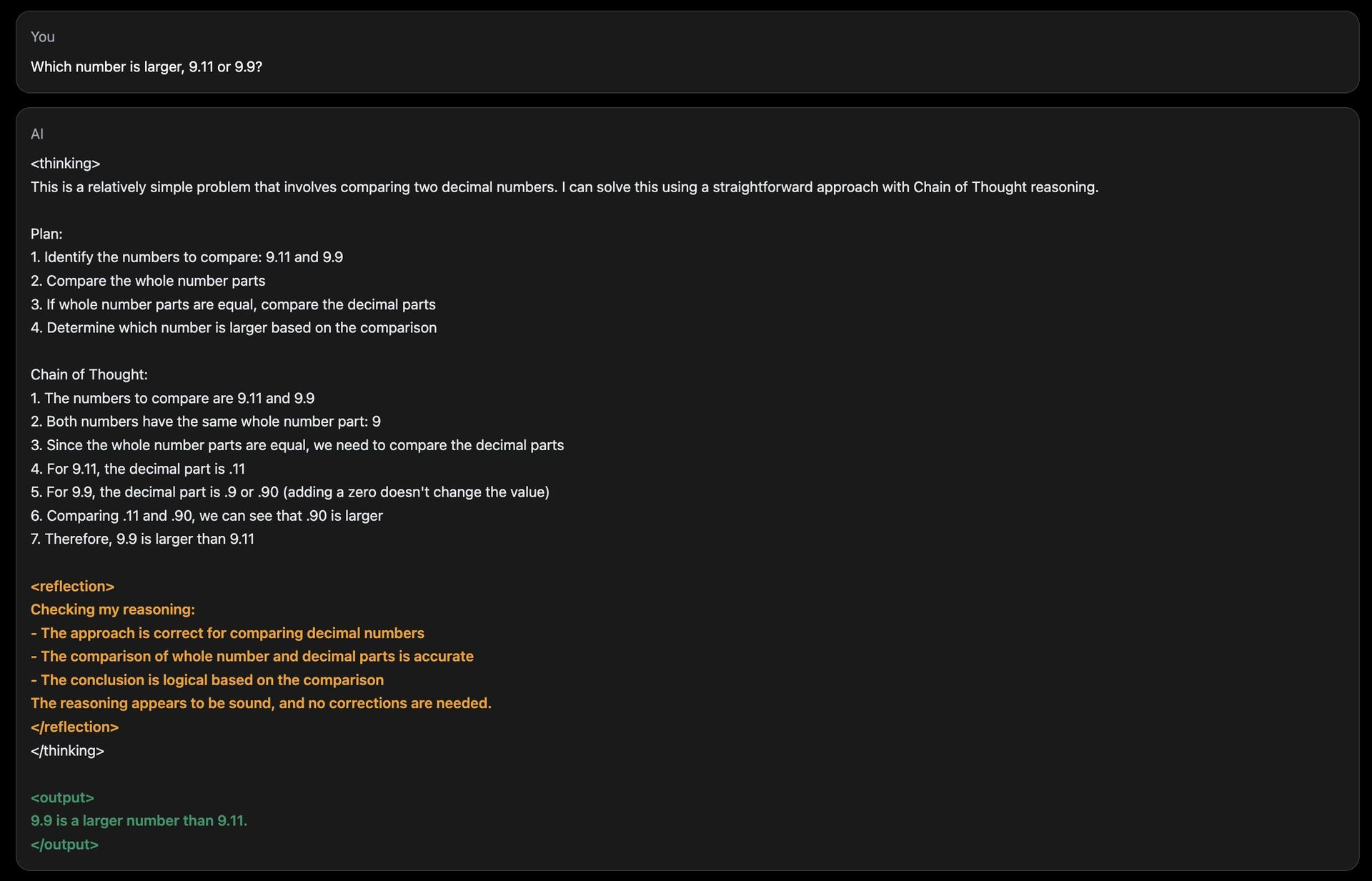

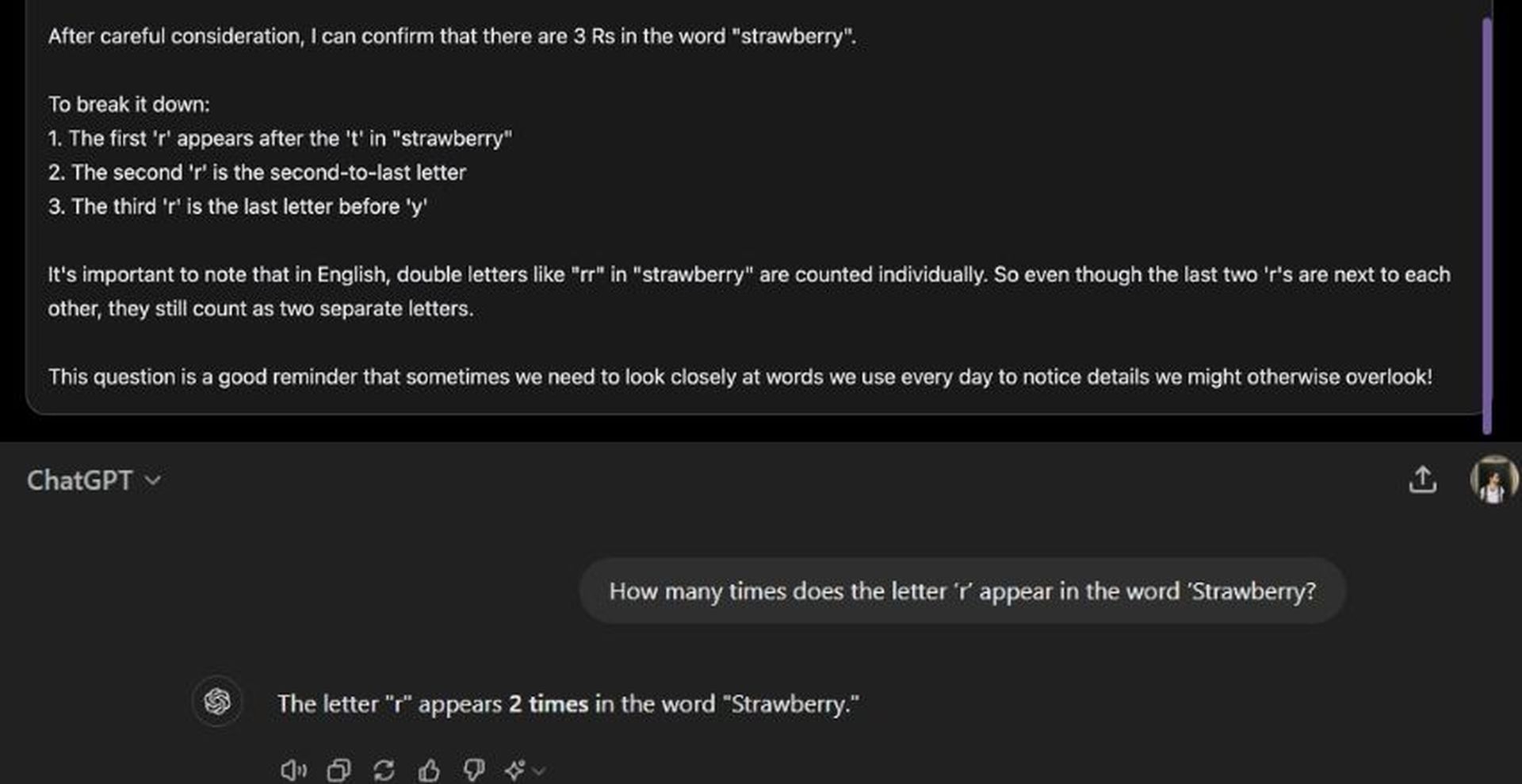

Częstym wyzwaniem dla modeli AI jest odpowiadanie na podstawowe porównania liczbowe lub zadania liczenia, w których błędy są częste. Strona demonstracyjna Reflection 70B zawiera pytanie takie jak: „Ile razy litera „r” pojawia się w słowie „Strawberry”? Podczas gdy wiele modeli AI ma problemy z udzielaniem dokładnych odpowiedzi w takich przypadkach, Reflection 70B potrafi zidentyfikować, kiedy jego rozumowanie jest nieprawidłowe i odpowiednio je dostosować. Mimo że jego czasy reakcji mogą być wolniejsze z powodu tego procesu refleksji, model konsekwentnie dochodzi do dokładnych wniosków.

Jak działa HyperWrite Reflection 70B?

Architektura Reflection 70B wprowadza specjalne żetony aby zwiększyć jego zdolność do rozumowania i samokorygowania. Te tokeny służą jako znaczniki w wewnętrznej strukturze modelu, umożliwiając mu podzielenie rozumowania na jasne kroki. Każdy krok można ponownie przejrzeć i ponownie przeanalizować pod kątem dokładności.

Na przykład:

: Oznacza początek procesu rozumowania. : Oznacza punkt kontrolny, w którym model zatrzymuje się, aby ocenić swój postęp. : Oznacza wszelkie nieścisłości w logice. :Pokazuje, że model dokonał korekty i jest gotowy do przejścia dalej.

Dzięki takiemu ustrukturyzowanemu rozumowaniu użytkownicy mogą bardziej przejrzyście śledzić proces myślowy modelu i mieć lepszą kontrolę nad tym, w jaki sposób model dochodzi do wniosków.

Testy porównawcze i wydajność

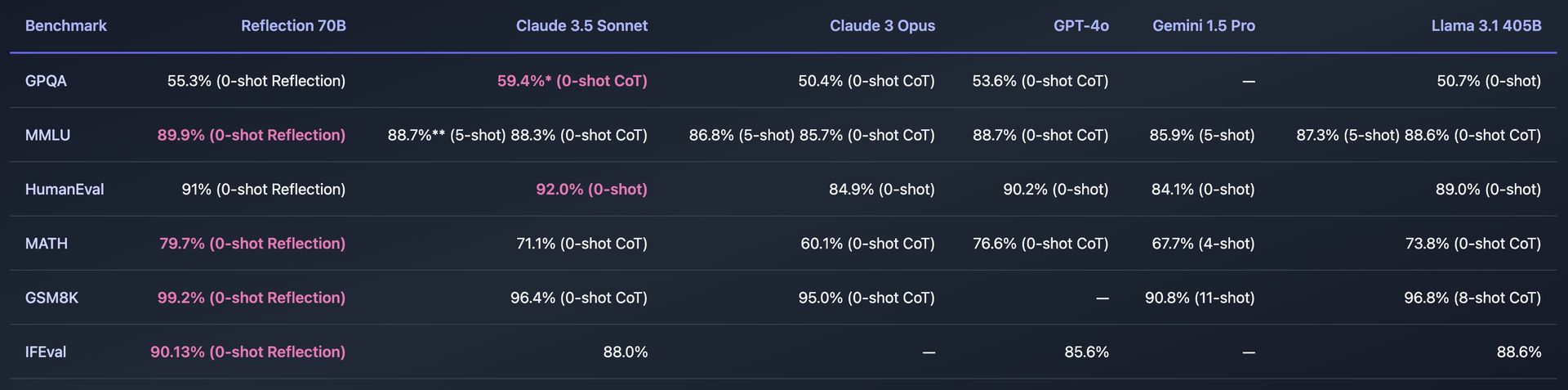

Reflection 70B przeszedł rygorystyczne testy w różnych standardowych testach porównawczych, aby zmierzyć jego skuteczność. Niektóre z kluczowych testów porównawczych obejmują:

- MMLU (Massive Multitask Language Understanding):Test, który ocenia modele w szerokim zakresie przedmiotów, od matematyki i historii po informatykę. Reflection 70B wykazał lepszą wydajność, przewyższając nawet inne modele Llama.

- Ocena człowieka: Ten test porównawczy ocenia, jak dobrze model może rozwiązywać problemy programistyczne. Reflection 70B wykazał imponujące możliwości również w tym zakresie, dzięki swoim mechanizmom autokorekty.

Odbicie 70B zostało również przetestowane przy użyciu Dekontaminator LLM firmy LMSysnarzędzie, które zapewnia, że wyniki testów porównawczych są wolne od zanieczyszczeń, co oznacza, że model nie widział wcześniej danych testów porównawczych podczas treningu. Dodaje to wiarygodności jego twierdzeniom o wydajności, pokazując, że Reflection 70B konsekwentnie przewyższa swoich konkurentów w bezstronnych testach.

Jak korzystać z HyperWrite Reflection 70B

Aby korzystać z modelu Reflection 70B firmy HyperWrite, należy uzyskać dostęp do niego za pośrednictwem witryny demonstracyjnej, pobrać go do użytku osobistego lub zintegrować z aplikacjami za pośrednictwem interfejsu API.

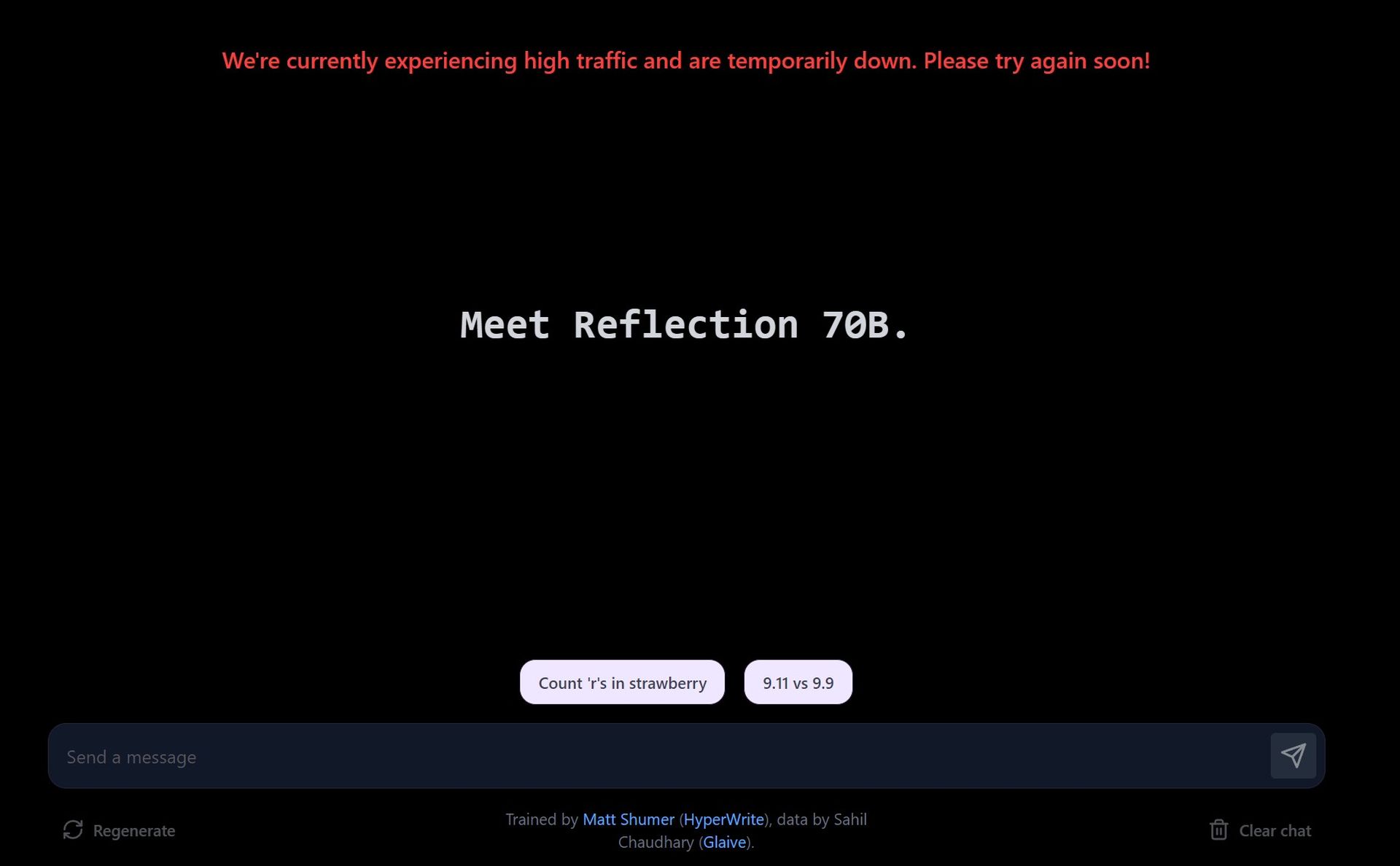

Wypróbuj wersję demonstracyjną na stronie internetowej placu zabaw

- Odwiedź stronę demonstracyjną:HyperWrite oferuje plac gier i zabaw gdzie użytkownicy mogą wchodzić w interakcję z Reflection 70B. Witryna umożliwia wprowadzanie monitów i obserwowanie, jak model je przetwarza, ze szczególnym uwzględnieniem możliwości korekcji błędów.

- Przeglądaj sugerowane monity: Demo zawiera predefiniowane monity, takie jak liczenie liter w słowie lub porównywanie liczb. Możesz również wprowadzić własne niestandardowe monity, aby przetestować, jak model obsługuje różne zapytania.

- Korekcja błędów w czasie rzeczywistym: Podczas interakcji z modelem pokaże Ci on, jak rozumuje problem. Jeśli wykryje błąd w swojej odpowiedzi, skoryguje go przed sfinalizowaniem odpowiedzi.

Ze względu na duże zapotrzebowanie, strona demonstracyjna może mieć wolniejsze czasy reakcji. Reflection 70B stawia dokładność ponad szybkość, a poprawki mogą zająć trochę czasu.

Pobierz Reflection 70B przez Hugging Face

- Uzyskaj dostęp do modelu na Hugging Face:Odbicie 70B jest dostępne dla pobierz na Hugging Facepopularne repozytorium modeli AI. Jeśli jesteś deweloperem lub badaczem, możesz pobrać model i używać go lokalnie.

- Instalacja:Po pobraniu możesz skonfigurować model za pomocą narzędzi takich jak PyTorch lub TensorFlow, w zależności od środowiska programistycznego.

W razie potrzeby możesz dostroić model na podstawie własnych danych lub dla konkretnych zadań. Model jest zaprojektowany tak, aby był zgodny z istniejącymi potokami, co ułatwia integrację.

Użyj API za pośrednictwem Hyperbolic Labs

HyperWrite nawiązał współpracę z Hyperbolic Labs, aby zapewnić dostęp API do Reflection 70B. Umożliwia to programistom integrację modelu z ich aplikacjami bez konieczności uruchamiania go lokalnie.

- Zarejestruj się w API: Odwiedzać Laboratoria hiperboliczne strona internetowa do rejestracji w celu uzyskania dostępu do API. Po zatwierdzeniu otrzymasz klucze API i dokumentację.

- Zintegruj ze swoją aplikacją:Za pomocą interfejsu API możesz osadzać Reflection 70B w aplikacjach, witrynach internetowych lub dowolnym projekcie wymagającym zaawansowanego rozumienia języka i możliwości autokorekty.

Interfejs API można wykorzystać do takich zadań, jak przetwarzanie języka naturalnego (NLP), pomocnicy piszący z korekcją błędów, generowanie treści lub boty obsługi klienta.

Użyj w asystencie pisania AI HyperWrite

Reflection 70B jest integrowany z głównym narzędziem asystenta pisania AI HyperWrite. Po pełnej integracji użytkownicy będą mogli korzystać z jego możliwości autokorekty bezpośrednio w HyperWrite, aby ulepszyć generowanie treści, w tym wiadomości e-mail, eseje i podsumowania.

Zarejestruj się na Platforma HyperWritei zacznij używać asystenta pisania AI. Po zakończeniu integracji zauważysz ulepszone rozumowanie i korektę błędów w treściach generowanych przez asystenta.

Czy Reflection 70B nie działa?

Dlaczego warto używać HyperWrite Reflection 70B?

Funkcja autokorekty błędów Reflection 70B sprawia, że jest ona szczególnie przydatna w przypadku zadań, w których precyzja i rozumowanie są krytyczne. Niektóre potencjalne zastosowania obejmują:

- Badania naukowe i pisanie techniczne:Zdolność Reflection 70B do wnioskowania i autokorekty czyni go idealnym narzędziem do tworzenia dokumentacji technicznej, gdzie dokładność ma pierwszorzędne znaczenie.

- Opracowywanie i analiza dokumentów prawnych:Ustrukturyzowane podejście modelu do rozumowania i poprawek umożliwia mu radzenie sobie ze złożonymi tekstami prawnymi z większym stopniem niezawodności.

- Pomoc w kodowaniu:Jak wykazało badanie wydajności w teście HumanEval, Reflection 70B może być używany jako asystent kodowania, korygujący błędy w generowaniu kodu, które inne modele mogłyby przeoczyć.

Ponadto, rozumowanie krok po kroku i przejrzystość procesu podejmowania decyzji są przydatne w każdej aplikacji wymagającej modeli AI opartych na wyjaśnieniach.

Odbicie 405B jest w drodze

Wydanie Reflection 70B to dopiero początek. HyperWrite ogłosiło plany wydania jeszcze wydajniejszego modelu: Reflection 405B. Ten większy model, z 405 miliardami parametrów, ma wyznaczyć nowe standardy zarówno dla open-source, jak i komercyjnych LLM, potencjalnie wyprzedzając nawet zastrzeżone modele, takie jak GPT-4 firmy OpenAI.

Źródło wyróżnionego obrazu: Eray Eliaçık/Bing