Colossus to przełomowy system szkoleniowy sztucznej inteligencji (AI) opracowany przez Elona Muska xAI Corp. Ten superkomputer, opisany przez Muska jako „najpotężniejszy system szkoleniowy AI na świecie”, jest kluczowym elementem strategii xAI, która ma na celu przejęcie pozycji lidera w szybko rozwijającej się dziedzinie sztucznej inteligencji.

W ten weekend @xAI zespół uruchomił nasz klaster szkoleniowy Colossus 100k H100. Od początku do końca zajęło to 122 dni.

Colossus to najpotężniejszy system szkoleniowy AI na świecie. Co więcej, jego rozmiar podwoi się do 200k (50k H200s) w ciągu kilku miesięcy.

Doskonały…

— Elon Musk (@elonmusk) 2 września 2024 r.

Nvidia będzie napędzać Colossusa

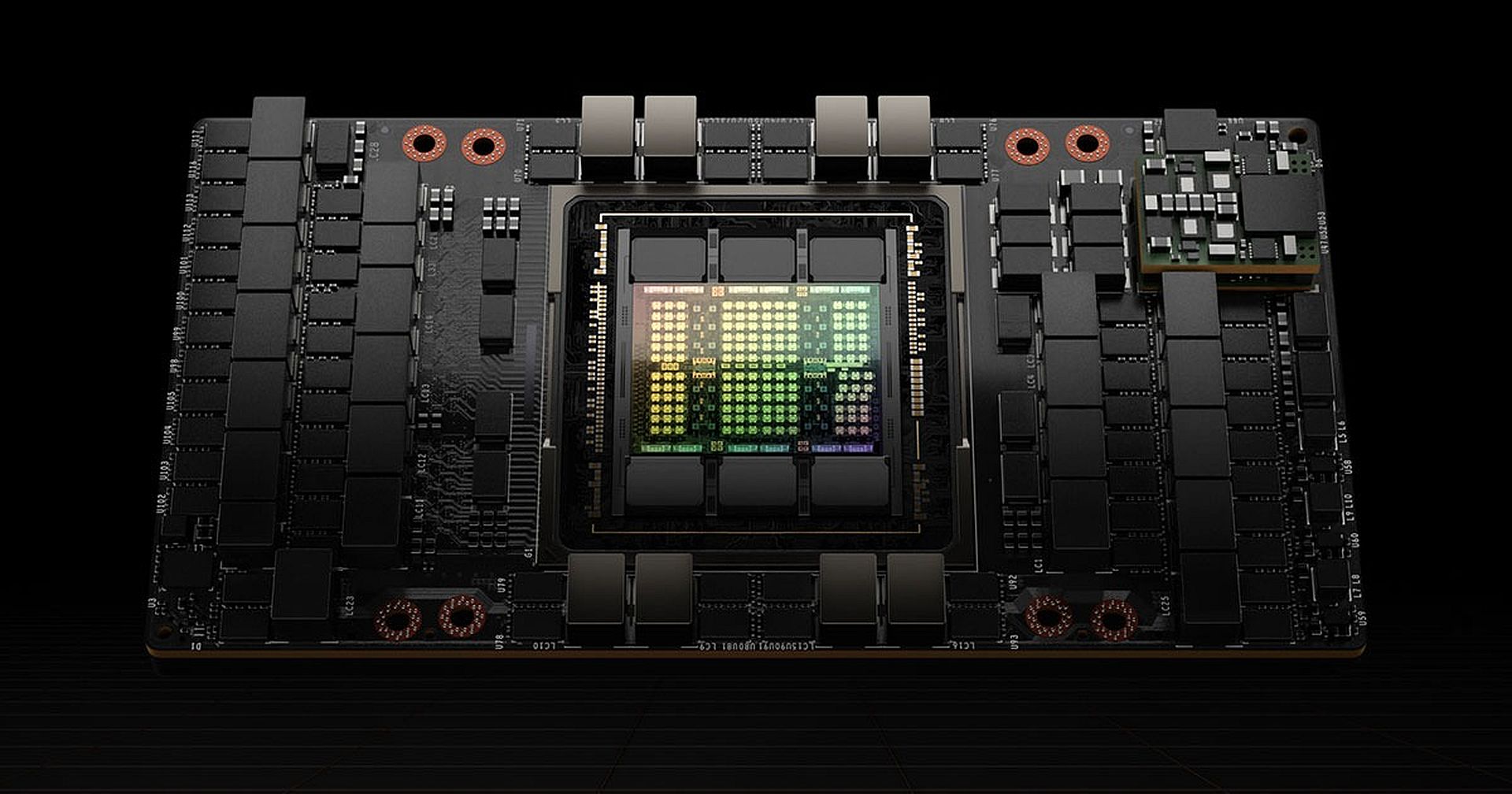

Sercem Colossusa są 100 000 Karty graficzne NVIDIA H100. Te procesory graficzne (GPU) zaprojektowano specjalnie z myślą o obsłudze wymagających obliczeń związanych ze szkoleniem sztucznej inteligencji. Oto dlaczego są one tak ważne:

- Surowa moc przetwarzania:Ten H100 jest flagowym procesorem AI firmy Nvidia, zaprojektowanym w celu przyspieszenia szkolenia i wnioskowania modeli AI, w szczególności tych opartych na głębokim uczeniu i sieciach neuronowych. W porównaniu do swojego poprzednika, H100 może uruchamiać modele językowe do 30 razy szybciej.

- Silnik transformatorowy:Kluczową cechą H100 jest Transformer Engine, specjalistyczny zestaw obwodów zoptymalizowanych do uruchamiania modeli AI opartych na architekturze sieci neuronowej Transformer. Ta architektura stanowi kręgosłup niektórych z najbardziej zaawansowanych modeli językowych, takich jak GPT-4 I Lama Meta 3.1 405BDzięki Transformer Engine procesory graficzne mogą wydajniej obsługiwać modele na dużą skalę, co czyni je idealnymi do szkolenia zaawansowanych systemów AI.

Następny poziom: Podwojenie z H200

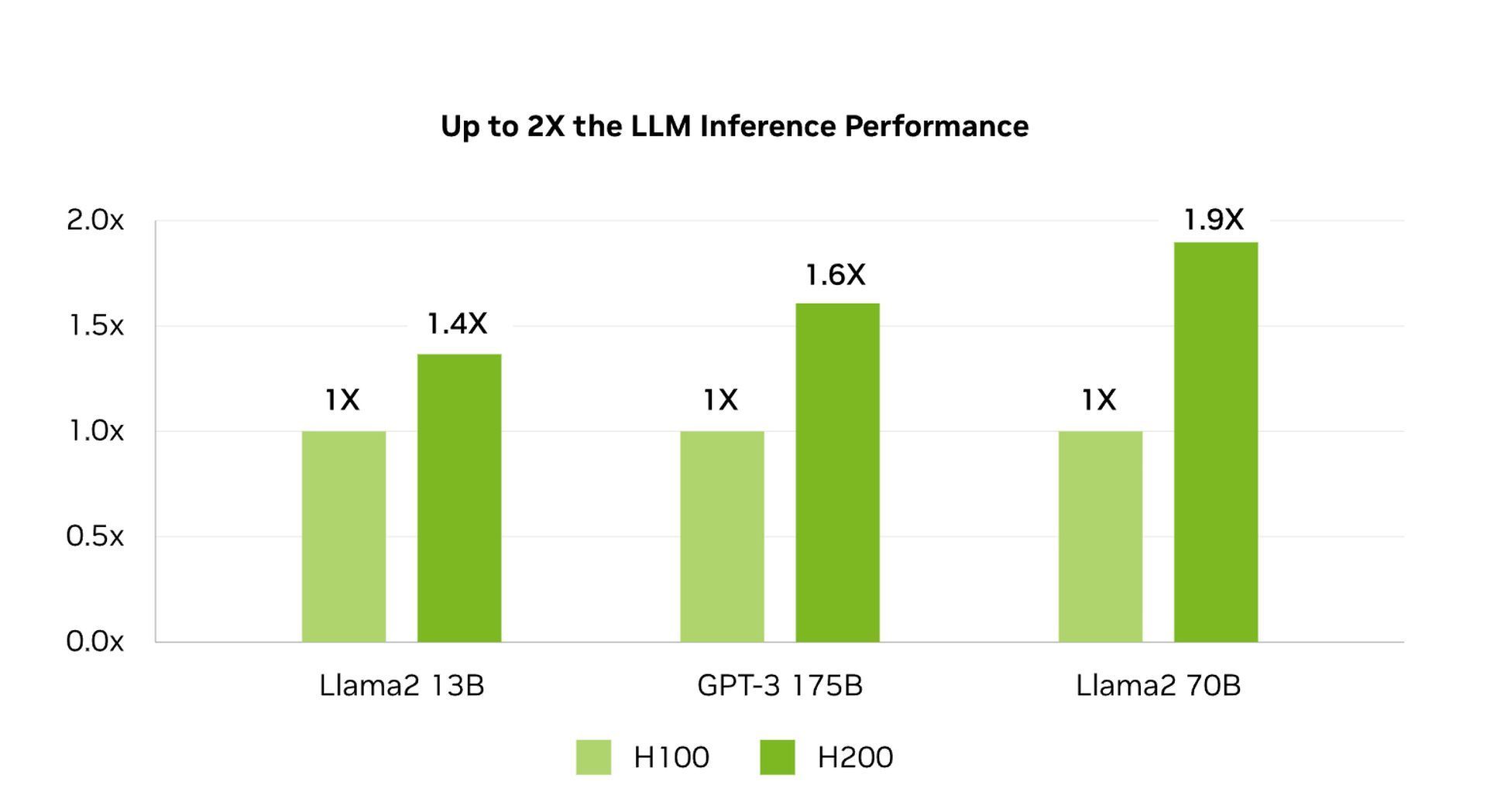

Musk ma ambitne plany dalszej rozbudowy Colossusa, których celem jest podwojenie liczby procesorów graficznych w systemie 200 000 w niedalekiej przyszłości. Ta ekspansja obejmie 50 000 jednostek H200 firmy Nvidiajeszcze mocniejszy następca H100. H200 oferuje kilka istotnych ulepszeń:

- Pamięć HBM3e:H200 wykorzystuje pamięć High Bandwidth Memory 3e (HBM3e), która jest szybsza niż pamięć HBM3 używana w H100. Ten typ pamięci zwiększa prędkość przesyłania danych między pamięcią a obwodami logicznymi układu. W przypadku modeli AI, które stale przesyłają ogromne ilości danych między przetwarzaniem a pamięcią, ta prędkość jest kluczowa.

- Zwiększona pojemność pamięci:H200 niemal podwaja pojemność pamięci pokładowej, 141 gigabajtów. Dzięki temu GPU może przechowywać więcej danych modelu AI bliżej jego obwodów logicznych, zmniejszając potrzebę pobierania danych z wolniejszych źródeł pamięci masowej. Rezultatem są szybsze czasy przetwarzania i bardziej wydajne szkolenie modelu.

Rola Colossusa w szkoleniu AI

Colossus jest specjalnie zaprojektowany do treningu duże modele językowe (LLM)które stanowią podstawę zaawansowanych zastosowań sztucznej inteligencji.

Ogromna liczba procesorów graficznych w Colossus pozwala xAI trenować modele AI w skali i z prędkością, których nie dorównują inne systemy. Na przykład obecny flagowy LLM xAI, Grok-2, został wytrenowany na 15 000 GPU. Mając teraz 100 000 GPU dostępnych, xAI może trenować znacznie większe i bardziej złożone modele, co potencjalnie prowadzi do znacznych ulepszeń w możliwościach AI.

Zaawansowana architektura procesorów graficznych H100 i H200 zapewnia, że modele są trenowane nie tylko szybciej, ale i z większą precyzją. Duża pojemność pamięci i szybkie możliwości przesyłania danych oznaczają, że nawet najbardziej złożone modele AI można trenować wydajniej, co przekłada się na lepszą wydajność i dokładność.

Co dalej?

Colossus to nie tylko osiągnięcie techniczne; to strategiczny atut w misji xAI, aby zdominować branżę AI. Tworząc najpotężniejszy na świecie system szkoleniowy AI, xAI pozycjonuje się jako lider w rozwijaniu najnowocześniejszych modeli AI. Ten system daje xAI przewagę konkurencyjną nad innymi firmami AI, w tym OpenAI, w którym obecnie działa Musk konflikt prawny z.

Ponadto budowa Colossus odzwierciedla szerszą wizję Muska dotyczącą AI. Realokując zasoby z Tesli do xAI, w tym przekierowując 12 000 procesorów graficznych H100 o wartości ponad 500 milionów dolarów, Musk demonstruje swoje zaangażowanie w AI jako centralny punkt swojego imperium biznesowego.

Czy mu się uda? Musimy poczekać na odpowiedź!

Źródło wyróżnionego obrazu: Eray Eliaçık/Grok