Poznaj Mixtral 8x7B firmy Mistral AI. Świetnie radzi sobie z dużymi zbiorami danych i może pomóc w zadaniach takich jak tłumaczenie języków i generowanie kodu. Deweloperzy na całym świecie są podekscytowani jego potencjałem usprawnienia projektów i poprawy wydajności. Dzięki przyjaznej dla użytkownika konstrukcji i imponującym możliwościom Mixtral 8x7B szybko staje się popularnym narzędziem do rozwoju sztucznej inteligencji.

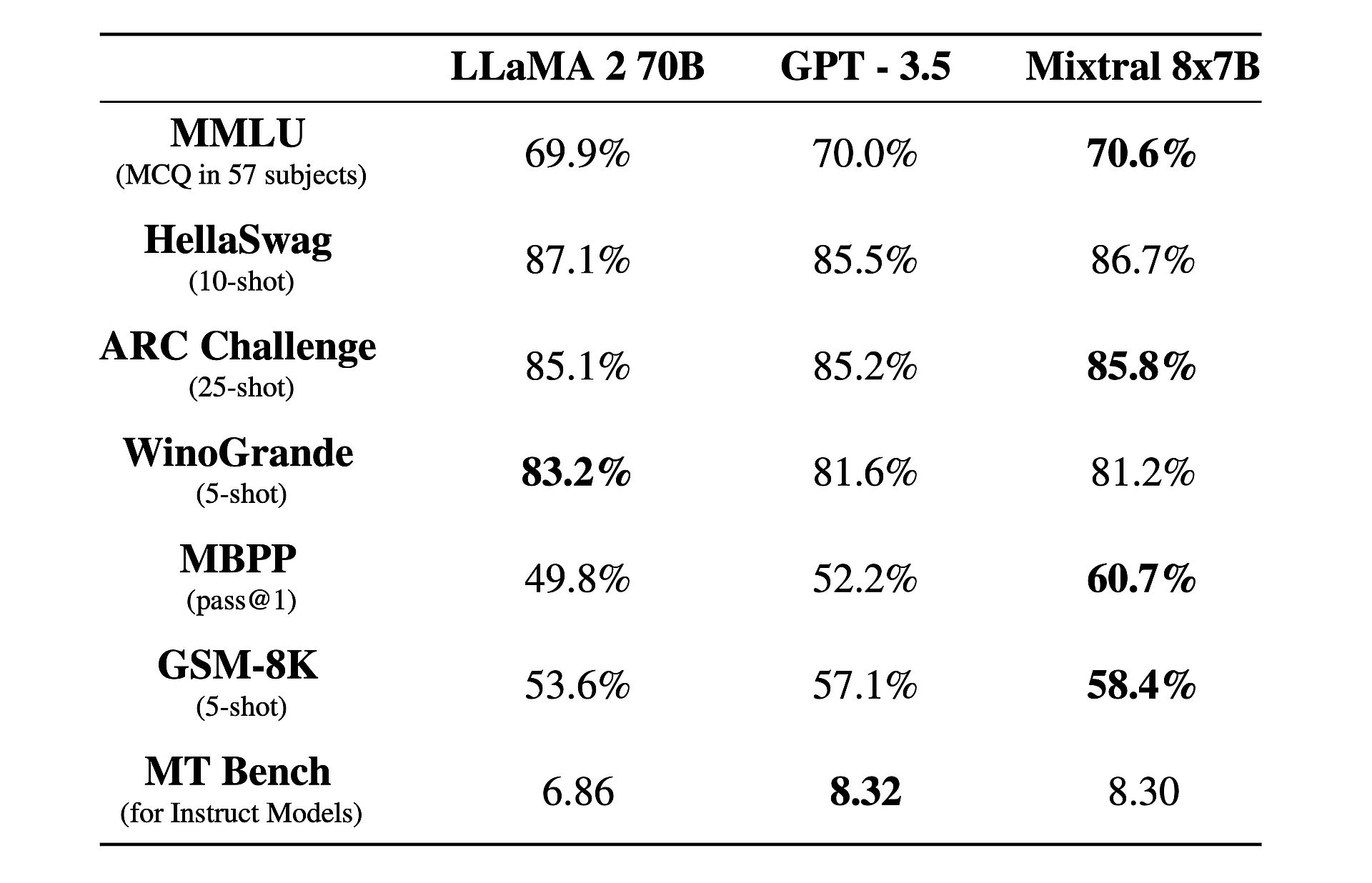

Jest też ciekawy fakt: działa lepiej niż GPT-3.5 I Lama 2!

Co to jest Mixtral 8x7B?

Mixtral 8x7B to zaawansowany model sztucznej inteligencji opracowany przez Mistral AI. Wykorzystuje unikalną architekturę zwaną rzadką mieszanką ekspertów (SMoE) do wydajnego przetwarzania dużych ilości danych. Pomimo swojej złożoności, Mixtral został zaprojektowany tak, aby był łatwy w użyciu i można go było dostosować do różnych zadań, takich jak tłumaczenie językowe i generowanie kodu. Przewyższa inne modele pod względem szybkości i dokładności, co czyni go cennym narzędziem dla programistów. Dodatkowo jest dostępny na licencji Apache 2.0, dzięki czemu każdy może z niego swobodnie korzystać i modyfikować.

Chcesz dowiedzieć się więcej? W istocie Mixtral 8x7B działa jako model przeznaczony wyłącznie do dekodera, wykorzystując unikalne podejście, w którym blok ze sprzężeniem zwrotnym wybiera jedną z ośmiu odrębnych grup parametrów, zwanych „ekspertami”. Eksperci ci są dynamicznie wybierani przez sieć routerów do przetwarzania każdego tokena, co zwiększa wydajność i wydajność, minimalizując jednocześnie obciążenie obliczeniowe.

Jedną z kluczowych mocnych stron Mixtrala są jego możliwości adaptacji i skalowalność. Capable może obsłużyć konteksty do 32 000 tokenów i obsługiwać wiele języków, w tym angielski, francuski, włoski, niemiecki i hiszpański. Mixtral umożliwia programistom wykonywanie szerokiego zakresu zadań z łatwością i precyzją.

Tym, co naprawdę wyróżnia Mixtral, jest stosunek wydajności do ceny. Dzięki oszałamiającej sumie 46,7 miliardów parametrów Mixtral osiąga niezwykłą wydajność, wykorzystując tylko ułamek tych parametrów na token, co skutkuje szybszym czasem wnioskowania i mniejszymi kosztami obliczeniowymi.

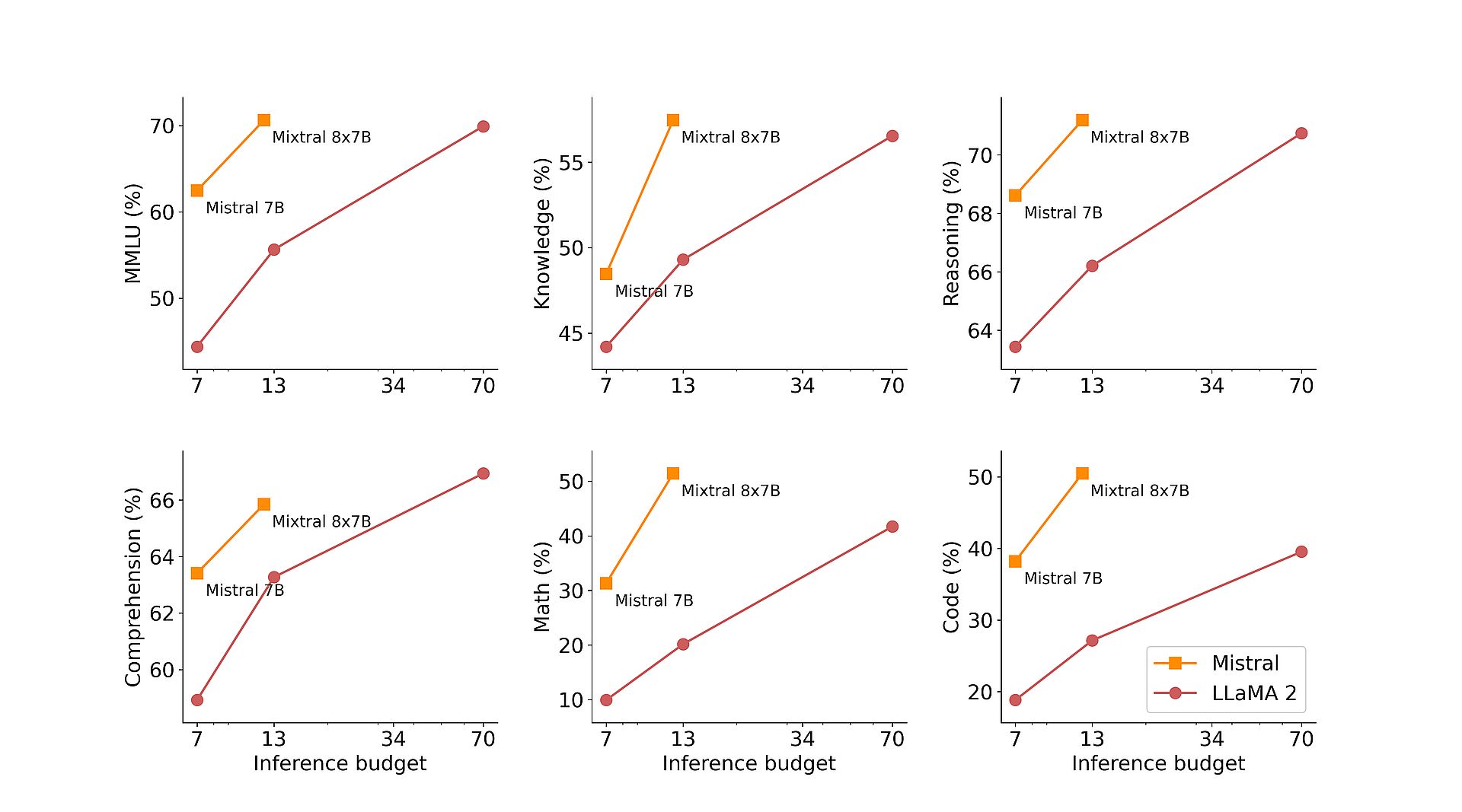

Co więcej, wstępne szkolenie Mixtrala na obszernych zbiorach danych pochodzących z otwartej sieci zapewnia solidność i wszechstronność w rzeczywistych zastosowaniach. Niezależnie od tego, czy chodzi o generowanie kodu, tłumaczenie językowe czy analizę nastrojów, Mixtral zapewnia znakomite wyniki w różnych testach porównawczych, przewyższając tradycyjne modele, takie jak Llama 2, a w wielu przypadkach nawet przewyższając GPT3.5.

Aby jeszcze bardziej zwiększyć swoje możliwości, Mistral AI wprowadził Mixtral 8x7B Instruct, wyspecjalizowany wariant zoptymalizowany do zadań wykonywanych zgodnie z instrukcjami. Osiągając imponujący wynik 8,30 w teście MT-Bench, Mixtral 8x7B Instruct umacnia swoją pozycję wiodącego modelu open source do nadzorowanego dostrajania i optymalizacji preferencji.

Oprócz swoich umiejętności technicznych, Mistral AI angażuje się w demokratyzację dostępu do Mixtral, wnosząc wkład w projekt vLLM, umożliwiając bezproblemową integrację i wdrożenie z narzędziami typu open source. Umożliwia to programistom wykorzystanie mocy Mixtral w szerokiej gamie aplikacji i platform, stymulując innowacje i postęp w dziedzinie sztucznej inteligencji.

Groq AIa nie Grok, piecze Elona Muska ze swoim „najszybszym LLM”

Jak używać Mixtrala 8x7B

Mixtral 8x7B jest dostępny poprzez punkt końcowy Mistral-small, który znajduje się w faza testów betami. Jeśli jesteś zainteresowany uzyskaniem wcześniejszego dostępu do wszystkich generatywnych i osadzających punktów końcowych Mistral, możesz rejestr Teraz. Rejestrując się, będziesz jednym z pierwszych, którzy poznają pełne możliwości Mixtral 8x7B i poznają jego innowacyjne rozwiązania.